Vereisten

Wanneer je luistert naar bedrijven over hun AI-ambities, is er vaak een diepe fascinatie voor modellen en algoritmen, maar een gemeenschappelijke blinde vlek voor de enorme industriële kracht die nodig is om deze systemen te draaien. De uitdaging is niet alleen het bouwen van intelligente software; het is het ontwerpen van de fysieke faciliteiten, robuuste netwerken en geavanceerde orkestratie die nodig zijn om AI te exploiteren op een schaal vergelijkbaar met een nationale nutsbedrijf. We hebben het over een wereldwijd netwerk van gespecialiseerde rekenkracht, niet zomaar een abstracte rekening van een cloudprovider.

Dit artikel ontleedt deze cruciale derde laag van AI – de datacenters en cloudservices – en toont hoe infrastructuur kan worden gebouwd die AI op industriële schaal kan ondersteunen. Mijn doel is om de fundamentele componenten te demystificeren en best practices uit praktijkimplementaties te delen, door AI niet als magie te behandelen, maar als de krachtige nutsvoorziening die het aan het worden is.

Om de concrete voorbeelden te volgen, heb je de standaard toolkit nodig voor productieklare Azure-implementaties. Werken met de nieuwste stabiele versies zorgt voor compatibiliteit en toegang tot essentiële functies.

- Azure CLI: Versie

2.58.0of hoger. Dit is mijn voorkeurstool voor alle programmatische interactie met Azure. Controleer je versie metaz --version. - Terraform CLI: Versie

1.7.0of hoger. Voor infrastructure-as-code is Terraform onmisbaar voor het creëren van herhaalbare, versiebeheerde omgevingen. Controleer metterraform version. kubectlCLI: Versie1.29of hoger. Dit is de universele standaard voor het beheren van Kubernetes-clusters. Verifieer metkubectl version --client.- Azure-abonnement: Je hebt een actief abonnement nodig met machtigingen om resources te maken, waaronder Kubernetes-clusters, virtuele netwerken en Front Door-instanties. Al mijn voorbeelden zullen Europese regio's gebruiken zoals

westeuropeennortheurope.

Architectuur: het nutsnetwerk voor intelligentie

De industriële laag van AI kan het beste worden begrepen door rekenkracht als een nutsvoorziening te behandelen. Net zoals een energiecentrale elektriciteit opwekt die via een netwerk naar huizen en fabrieken stroomt, genereren datacenters AI-rekenkracht die via wereldwijde netwerken naar applicaties stroomt. Veel organisaties onderschatten de fysieke en logistieke uitdagingen. Het gaat niet om het opstarten van een paar VM's; het gaat om het optimaliseren van stroom, koeling, netwerkinterconnectiviteit en beveiliging op een enorme, onvergeeflijke schaal.

In het hart van deze laag bevinden zich de moderne datacenters die worden beheerd door cloudproviders zoals Microsoft Azure, Amazon of Google. Deze faciliteiten herbergen enorme hoeveelheden gespecialiseerde hardware – met name GPU's – onderling verbonden door netwerken met hoge bandbreedte en lage latentie. Cloudservices abstraheren deze fysieke complexiteit, en bieden schaalbare rekenkracht (zoals Azure Kubernetes Service voor GPU-workloads), intelligent netwerken (Azure Front Door voor wereldwijd verkeersbeheer) en robuuste orkestratie (Azure Functions, Durable Functions en Service Bus).

De fysieke realiteit achter de cloud

Wanneer je door datacenters loopt, is de schaal verbijsterend. Het gezoem van duizenden servers, de enorme hoeveelheid lucht die wordt verplaatst door massieve koelsystemen, en de eindeloze rekken met zorgvuldig bekabelde glasvezel – dit is de fysieke basis van AI. Voor elk model dat in de cloud draait, is er een overeenkomstige uitgave van elektriciteit en een tastbare fysieke voetafdruk. Deze realiteit ondersteunt de gehele derde laag en heeft aanzienlijke FinOps (d.w.z. financiële) implicaties.

Deze componeerbare aanpak, waarbij we AI bouwen met behulp van onderling verbonden, gespecialiseerde services, is de sleutel. In plaats van monolithische systemen maken we gebruik van standaard API's voor interoperabiliteit, wat onze beste verdediging is tegen vendor lock-in.

Belangrijkste architectonische componenten

Voor een AI-systeem op industriële schaal richt ik me op vier hoofdpijlers:

-

High-Performance Compute Clusters: Dit is waar het zware werk van AI-training en inferentie plaatsvindt. De keuze is vaak een beheerde Kubernetes-service zoals Azure Kubernetes Service (AKS) die draait op GPU-compatibele virtuele machines (ik zal binnenkort schrijven over serverloze GPU's). Het biedt de nodige orkestratie voor het implementeren, schalen en beheren van gecontaineriseerde AI-workloads zonder de overhead van het beheer van het controlepaneel.

-

Wereldwijd netwerk en edge-levering: AI-applicaties moeten snel en responsief zijn, ongeacht de locatie van de gebruiker. Gebruik services zoals Azure Front Door of het wereldwijde netwerk van Cloudflare als het intelligente toegangspunt. Ze verzorgen TLS-terminatie, caching, DDoS-bescherming en efficiënte verkeersroutering naar de dichtstbijzijnde gezonde backend. Dit is ononderhandelbaar voor het minimaliseren van latentie.

-

Gegevensopslag en -beheer: AI-workloads zijn datahongerig. Dit vereist een veelzijdige opslagstrategie: objectopslag (Azure Blob Storage) voor grote datasets en modelartefacten, gespecialiseerde vector databases voor Retrieval-Augmented Generation (RAG)-patronen, en traditionele databases voor applicatiestatus. Robuuste datapijplijnen zijn het circulatiesysteem dat ze allemaal verbindt.

-

Orkestratie en automatisering: Naast basisrekenkracht is het orkestreren van complexe AI-workflows van cruciaal belang. Dit omvat het gebruik van serverloze componenten zoals Azure Functions of Google Cloud Run-functies voor staatloze taken (bijv. het voorbewerken van een API-verzoek) en Durable Functions voor stateful, langlopende workflows. Berichten services zoals Azure Service Bus bieden de duurzame, asynchrone verbinding tussen deze microservices.

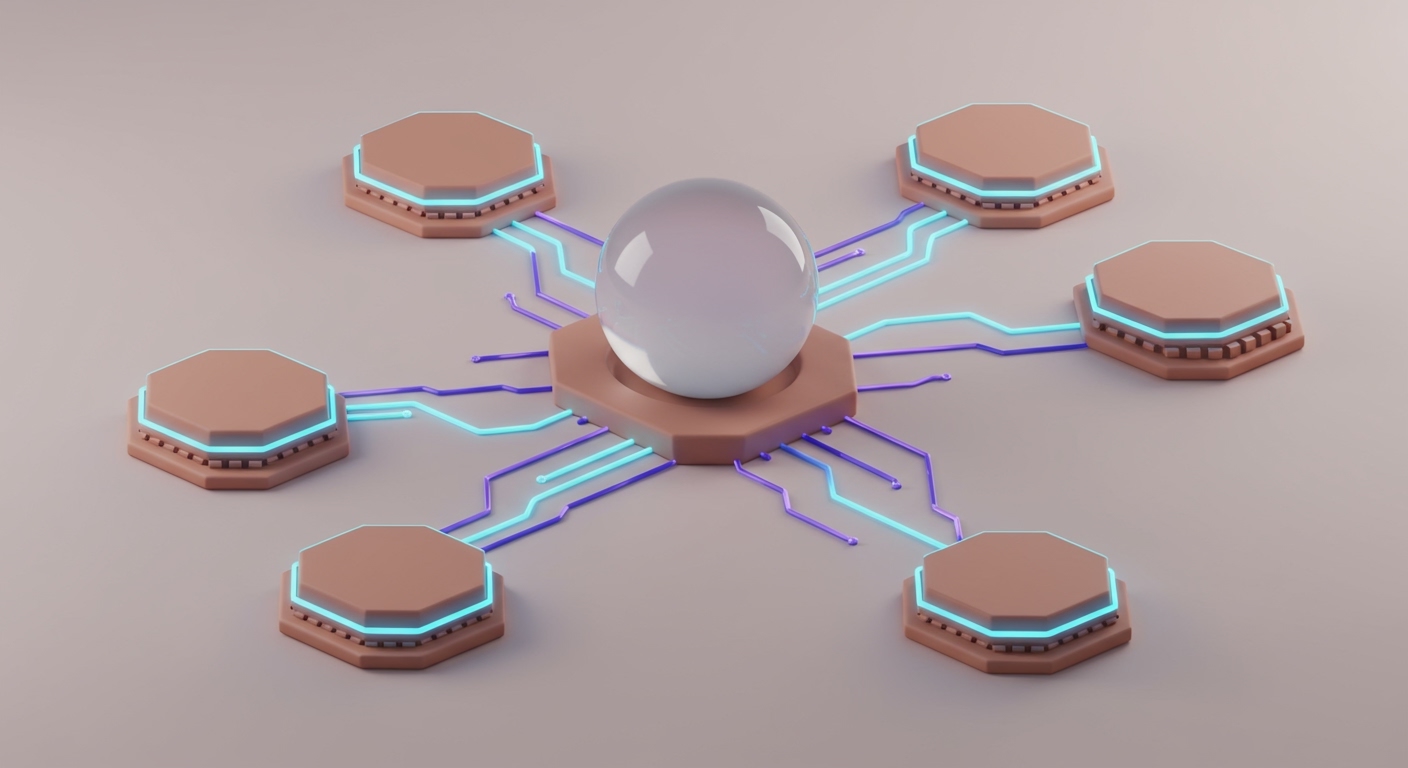

Hier is een diagram dat toont hoe deze elementen interageren om een samenhangende industriële AI-laag te vormen.

Modelgovernance en beveiliging

Voor elke productieworkload zijn modelgovernance en beveiliging niet optioneel. Dit is een basischecklist voor het waarborgen van de integriteit, controleerbaarheid en verantwoord gebruik van AI-modellen op schaal:

- Versiebeheer: Modellen zijn software-artefacten. Ze moeten worden geversionneerd in een speciaal register, zoals dat in Azure Machine Learning, om rollbacks en traceerbare implementatiegeschiedenissen mogelijk te maken.

- Strikte toegangscontrole: Gebruik gedetailleerde IAM-beleidsregels om te bepalen wie toegang heeft tot, modellen kan implementeren en aanroepen. Het principe van de minste privileges is van het grootste belang.

- Uitgebreide auditlogging: Registreer elke modelaanroep, inclusief invoergegevens (of de hash daarvan), uitvoer en de identiteit van de aanroeper. Dit is essentieel voor traceerbaarheid en compliance.

- Beveiligde eindpunten: Alle modellen moeten worden geïmplementeerd achter een beveiligde API-gateway die authenticatie, autorisatie en rate limiting afdwingt.

- Dataversleuteling: Alle gegevens, zowel onderweg over het netwerk als in rust in opslag, moeten worden versleuteld met sterke, beheerde sleutels.

Met deze architectonische blauwdruk in gedachten, leggen we het eerste deel van onze fundering: het rekencluster.

Codevoorbeeld: Terraform voor een GPU-geschakeld AKS-cluster

Deze Terraform-configuratie voorziet een Azure Kubernetes Service (AKS)-cluster van een dedicated nodepool voor GPU-compatibele machines in westeurope. Dit is het fundamentele rekenblok voor onze industriële AI-implementatie.

# main.tf

# Configure the Azure provider to a European region

provider "azurerm" {

features {}

# Using 'westeurope' as our primary region for compute resources.

# For HA systems, we'd deploy to multiple European regions.

}

resource "azurerm_resource_group" "ai_infra_rg" {

name = "ai-compute-rg-production-eu"

location = "westeurope"

}

resource "azurerm_kubernetes_cluster" "ai_aks_cluster" {

name = "ai-industrial-aks-eu-01"

location = azurerm_resource_group.ai_infra_rg.location

resource_group_name = azurerm_resource_group.ai_infra_rg.name

dns_prefix = "ai-aks-eu"

kubernetes_version = "1.29.4" # Align with current stable AKS versions

default_node_pool {

name = "systempool"

node_count = 2

vm_size = "Standard_DS2_v2"

os_disk_size_gb = 30

auto_scaling_enabled = true

min_count = 1

max_count = 3

}

identity {

type = "SystemAssigned"

}

network_profile {

network_plugin = "azure"

load_balancer_sku = "standard"

service_cidr = "10.0.0.0/16"

dns_service_ip = "10.0.0.10"

docker_bridge_cidr = "172.17.0.1/16"

}

tags = {

"project" = "AIIndustrialScale"

"environment" = "Production"

}

}

# Dedicated node pool for GPU workloads, critical for industrial AI scale.

# This uses 'Standard_NC6s_v3' with NVIDIA V100 GPUs.

resource "azurerm_kubernetes_cluster_node_pool" "ai_gpu_node_pool" {

name = "gpunodepool"

kubernetes_cluster_id = azurerm_kubernetes_cluster.ai_aks_cluster.id

vm_size = "Standard_NC6s_v3"

node_count = 0 # Start with 0 and scale as needed to manage costs

os_disk_size_gb = 60

auto_scaling_enabled = true

min_count = 0

max_count = 5 # Scale up to 5 GPU nodes based on demand

node_labels = {

"agentpool" = "gpunodepool"

"gpu" = "nvidia-v100"

}

tags = {

"environment" = "production"

"ai_layer" = "industrial"

}

}

output "kubernetes_cluster_name" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.name

description = "The name of the Kubernetes cluster."

}

output "kubernetes_cluster_id" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.id

description = "The ID of the Kubernetes cluster."

}

Implementatiegids

Het uitbouwen van de industriële AI-laag is een methodisch proces. Verdeel het in het beveiligen van de kernrekenkracht, het opzetten van wereldwijde netwerktoegang en vervolgens het implementeren van de AI-workloads. Elke stap richt zich op het creëren van robuuste, schaalbare infrastructuur die geschikt is voor operaties op nuts-schaal.

1. Het inrichten van het GPU-geschakelde AKS-cluster

Eerst implementeren we het fundamentele rekencluster met behulp van de bovenstaande Terraform-configuratie.

# Initialize Terraform in your project directory

terraform init

# Review the planned changes before applying

terraform plan -out=aks_gpu_plan.tfplan

# Apply the Terraform configuration to provision resources

terraform apply "aks_gpu_plan.tfplan"

Na enkele minuten zal Terraform zijn voltooid en ziet u de uitvoer die de aanmaak van het cluster bevestigt.

Verwachte uitvoer:

Apply complete! Resources: 3 added, 0 changed, 0 destroyed.

Outputs:

kubernetes_cluster_id = "/subscriptions/<your-subscription-id>/resourceGroups/ai-compute-rg-production-eu/providers/Microsoft.ContainerService/managedClusters/ai-industrial-aks-eu-01"

kubernetes_cluster_name = "ai-industrial-aks-eu-01"

Dit bevestigt dat uw AKS-cluster, met zijn GPU-nodenpool klaar voor schaling, succesvol is geïmplementeerd in westeurope.

2. Configureer `kubectl

Zodra het cluster actief is, moet u uw lokale

kubectl`-client configureren om ermee te interageren. De Azure CLI maakt dit eenvoudig door de clusterreferenties op te halen.

# Get AKS cluster credentials (using admin for simplicity, use user auth in production)

az aks get-credentials --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --overwrite-existing --admin

# Verify kubectl connectivity by listing nodes

kubectl get nodes

Verwachte uitvoer:

Merged "ai-industrial-aks-eu-01-admin" as current context in /home/mark/.kube/config.

NAME STATUS ROLES AGE VERSION

aks-systempool-12345678-vmss000000 Ready agent 5m v1.29.4

aks-systempool-12345678-vmss000001 Ready agent 5m v1.29.4

Merk op dat de gpunodepool-nodes nog niet worden weergegeven. Dat komt omdat we de initiële node_count op 0 hebben ingesteld. Ze zullen worden ingericht door de cluster-autoscaler zodra een workload GPU-resources aanvraagt.

3. Een AI-inferentieworkload implementeren op GPU-nodes

Laten we nu een voorbeeld van een AI-inferentieservice implementeren. Dit Kubernetes Deployment-manifest instrueert de scheduler om onze container op een GPU-compatibele node uit te voeren, waardoor onze orkestratielaag wordt verbonden met de gespecialiseerde hardware.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: gpu-inference-app

labels:

app: gpu-inference

spec:

replicas: 1

selector:

matchLabels:

app: gpu-inference

template:

metadata:

labels:

app: gpu-inference

spec:

# Node affinity ensures this workload runs only on a node with the specified GPU.

nodeSelector:

gpu: "nvidia-v100"

containers:

- name: inference-container

# In a real scenario, you'd use your custom AI model image.

# This public image is a base with CUDA drivers installed.

image: "mcr.microsoft.com/azureml/intelmpi2018.3-cuda10.0-cudnn7-ubuntu16.04:20191010.v1"

resources:

limits:

nvidia.com/gpu: 1 # Request 1 GPU from the node

ports:

- containerPort: 80

---

apiVersion: v1

kind: Service

metadata:

name: gpu-inference-service

spec:

selector:

app: gpu-inference

ports:

- protocol: TCP

port: 80

targetPort: 80

type: LoadBalancer # Expose the service with a public IP via Azure Load Balancer

Pas deze configuratie toe op uw cluster:

# Apply the Kubernetes deployment and service

kubectl apply -f ai-inference-deployment.yaml

Verwachte uitvoer:

deployment.apps/gpu-inference-app created

service/gpu-inference-service created

Dit triggert de AKS-autoscaler. Deze ziet een pod die een GPU vereist, merkt op dat er geen beschikbare nodes zijn en begint met het inrichten van een nieuwe node in de gpunodepool.

4. Het opzetten van wereldwijd edge-netwerken met Azure Front Door

Om onze AI-service wereldwijd toegankelijk te maken met lage latentie, plaatsen we er een wereldwijde load balancer zoals Azure Front Door voor. Hoewel de volledige Terraform-configuratie uitgebreid is, toont dit conceptuele fragment de belangrijkste resources.

# networking.tf (conceptual)

# A Web Application Firewall (WAF) policy is a prerequisite for Front Door.

resource "azurerm_cdn_frontdoor_firewall_policy" "ai_waf_policy" {

name = "ai-app-waf-policy"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

enabled = true

mode = "Prevention"

}

# The Front Door profile is the top-level resource.

resource "azurerm_cdn_frontdoor_profile" "ai_afd_profile" {

name = "ai-global-frontdoor-profile"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

}

# An endpoint provides the public-facing hostname.

resource "azurerm_cdn_frontdoor_endpoint" "ai_afd_endpoint" {

name = "ai-endpoint-eu-prod-unique"

cdn_frontdoor_profile_id = azurerm_cdn_frontdoor_profile.ai_afd_profile.id

}

# In a complete configuration, you would also define:

# 1. An Origin Group pointing to the public IP of the 'gpu-inference-service'.

# 2. A Route to connect the public endpoint to the origin group.

# 3. A Security Policy to associate the WAF policy with the endpoint.

Deze setup maakt gebruik van het wereldwijde edge-netwerk van Microsoft. Een gebruikersaanvraag raakt het dichtstbijzijnde Point-of-Presence (PoP), dat het vervolgens efficiënt routeert via Microsoft's privé-backbone naar onze inferentieservice in westeurope, wat een snelle en veilige ervaring biedt.

Probleemoplossing en verificatie

Het waarborgen van de robuustheid van uw industriële AI-infrastructuur vereist grondige verificatie. Naar mijn ervaring komen de meeste problemen voort uit verkeerde configuraties in netwerken, IAM-machtigingen of resource-allocatie.

Verificatiecommando's

- Controleer de AKS-clusterstatus:

az aks show --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --query "provisioningState"

**Verwachte uitvoer:** `"Succeeded"`

- Verifieer de aanwezigheid van GPU-nodes (na pod-implementatie):

kubectl get nodes --selector=gpu=nvidia-v100

**Verwachte uitvoer (na autoscaling):**

NAME STATUS ROLES AGE VERSION

aks-gpunodepool-12345678-vmss000000 Ready agent 10m v1.29.4

- Controleer de status van de AI-inferentiepod:

kubectl get pod -l app=gpu-inference

**Verwachte uitvoer:** `STATUS` moet `Running` zijn.

- Haal het externe IP-adres van de inferentieservice op:

kubectl get service gpu-inference-service

**Verwachte uitvoer:** Het veld `EXTERNAL-IP` toont na enkele minuten een openbaar IP-adres. Dit is het IP-adres dat u configureert in uw Front Door-origin.

Veelvoorkomende fouten en oplossingen

-

Fout: Pod blijft hangen in de status

Pendingmet eennvidia.com/gpuresourcewaarschuwing.- Symptoom:

kubectl describe pod <pod-name>toont een gebeurtenis zoalsFailedScheduling... 0/3 nodes are available: 3 Insufficient nvidia.com/gpu. - Oplossing: Dit is in eerste instantie te verwachten. De cluster-autoscaler zou een nieuwe GPU-node moeten inrichten. Als dit langer dan 5-10 minuten duurt, controleer dan de AKS-diagnostiek op autoscaler-fouten. Controleer ook of uw

nodeSelectorin de deployment YAML exact overeenkomt met denode_labelsin uw Terraform-configuratie.

- Symptoom:

-

Fout: Service

EXTERNAL-IPblijft lange tijd<pending>.- Oplossing: Dit betekent meestal dat de Azure Load Balancer tijd nodig heeft om een openbaar IP-adres in te richten. Als dit langer dan 15 minuten aanhoudt, controleer dan de activiteitslogboeken van de resourcegroep op eventuele inrichtingsfouten. Het kan ook betekenen dat u een quotum voor openbare IP-adressen in uw abonnement hebt bereikt.

-

FinOps-waarschuwing: kosten voor inactieve GPU's

- Symptoom: Uw cloudfactuur toont hoge kosten voor GPU VM's, maar de gebruiksstatistieken zijn laag.

- Oplossing: Dit is een klassiek FinOps-probleem. Zorg ervoor dat uw cluster-autoscaler correct is geconfigureerd om niet alleen op te schalen, maar ook af te schalen. Stel

min_count = 0in op dure nodepools die niet altijd nodig zijn. Monitor pod-planning en node-gebruik nauwkeurig om ervoor te zorgen dat u niet betaalt voor inactieve, dure hardware.

Conclusie en volgende stappen

De derde laag van AI – de industriële ruggengraat van datacenters en cloudservices – is waar het echte werk gebeurt. Het is de kritieke infrastructuur die krachtige modellen transformeert in schaalbare, betrouwbare, wereldwijde nutsvoorzieningen. Als architect benadruk ik voortdurend dat het verwaarlozen van deze fundering gelijk staat aan het bouwen van een wolkenkrabber op zand. Het succes van AI op schaal hangt volledig af van de robuuste, wereldwijde infrastructuur die we implementeren.

Een nutsvoorziening-mindset omarmen

De metafoor van 'AI als een nutsvoorziening' is niet alleen conceptueel; het moet onze architectonische keuzes bepalen. We ontwerpen voor veerkracht, schaalbaarheid en efficiëntie, net zoals een operator van een stroomnetwerk dat zou doen. Dit omvat alles van energiezuinige datacenterontwerpen tot geautomatiseerde schaling van GPU-clusters en geografisch gedistribueerde netwerken. De financiële implicaties zijn ook diepgaand, wat een rigoureuze FinOps-strategie vereist om de aanzienlijke operationele kosten te beheren.

Belangrijkste leerpunten

- Fysieke fundamenten zijn belangrijk: De AI-"cloud" is een enorme fysieke infrastructuur die zorgvuldige planning vereist voor stroom, koeling en connectiviteit.

- Orkestratie is cruciaal: Beheerd Kubernetes (zoals AKS met GPU-nodes) is essentieel voor het efficiënt implementeren en beheren van AI-workloads.

- Wereldwijd netwerken is ononderhandelbaar: Edge-netwerken en wereldwijde load balancers (zoals Azure Front Door) zijn essentieel voor AI-diensten met lage latentie en hoge beschikbaarheid.

- Infrastructure as Code is verplicht: Tools zoals Terraform zijn cruciaal voor herhaalbare, consistente en versiebeheerde infrastructuurimplementaties.

Repository-bronnen

De complete, projectspecifieke code voor een dergelijke uitgebreide architectuur wordt doorgaans bewaard in privé-clientrepositories. De officiële documentatie en openbare voorbeelden hieronder zijn echter uitstekende startpunten voor elk onderdeel.

- Azure Quickstart Templates for AKS: `https://github.com/Azure/azure-quickstart-templates/tree/master/quickstarts/microsoft.containerservice/aks

* **Terraform Azure Provider Examples:**

https://github.com/hashicorp/terraform-provider-azurerm/tree/main/examples

* **Advanced Azure ML Examples:**

https://github.com/Azure/azureml-examples

* **Kubernetes Documentation:**

https://kubernetes.io/docs/home/`