Randvoorwaarden

De vijfde AI-laag: Waar modellen de realiteit en ROI ontmoeten

Bij AI-initiatieven is het knelpunt zelden het algoritme zelf. Er zijn talloze organisaties die zwaar investeren in de fundamentele lagen van AI – het aanschaffen van geavanceerde GPU's, het bouwen van enorme datalakes en het trainen van geavanceerde modellen. Toch ontstaat er een veelvoorkomende en kostbare valkuil wanneer het tijd is om het daadwerkelijke rendement op die investering te realiseren: de applicatielaag. Dit is de "laatste mijl" van AI, waar de theoretische kracht van een model naadloos moet integreren in bestaande bedrijfsworkflows, beveiligde systemen en gebruikerservaringen.

Briljante modellen blijven ongebruikt omdat ze niet veilig konden integreren met oudere databases zoals SAP of Oracle EHR's, niet voldeden aan compliance-vereisten, of eenvoudigweg niet konden opschalen om aan de gebruikersvraag te voldoen. De uitdaging is niet alleen om een AI-model te laten werken; het gaat erom het in de echte wereld te laten werken om meetbaar economisch voordeel te leveren.

De applicatielaag is de "laatste mijl" van kunstmatige intelligentie – en het is de enige laag die rendement op investering (ROI) genereert. Als een AI-applicatie niet veilig kan integreren met bestaande enterprise identity providers (IAM), oudere databases (SAP, Oracle, ziekenhuis-EHR's) en gebruikersworkflows, zijn de enorme kapitaaluitgaven aan GPU's en modeltraining volledig verspild.

Deze gids is een in de praktijk geteste benadering voor het architecten en implementeren van AI-applicaties die deze kloof overbruggen. We behandelen de cruciale overwegingen voor het opbouwen van deze "vijfde AI-laag" en het omzetten van modellen in waarde.

Voordat we beginnen met het implementeren van AI-toepassingen, is het cruciaal om de juiste tools en fundamentele kennis te hebben. Ik adviseer mijn klanten altijd om te standaardiseren op een modern containerorchestratieplatform en hun kern-cloudtools gereed te hebben. Voor de volgende voorbeelden ga ik ervan uit dat u bekend bent met:

- Containerisatie:

Docker Engine(versie24.0of nieuwer). - Kubernetes: Een draaiend cluster en een geconfigureerde

kubectl-client (versie1.28of nieuwer). - Cloud Provider CLI: De

gcloud-,aws- ofaz-CLI, afhankelijk van uw gekozen cloudprovider. - Python 3.9+: Voor het ontwikkelen van applicatielogica en API-interacties.

- Netwerkfundamentals: Een solide begrip van load balancing, ingress controllers en service meshes.

Architectuur: De blauwdruk voor real-world AI

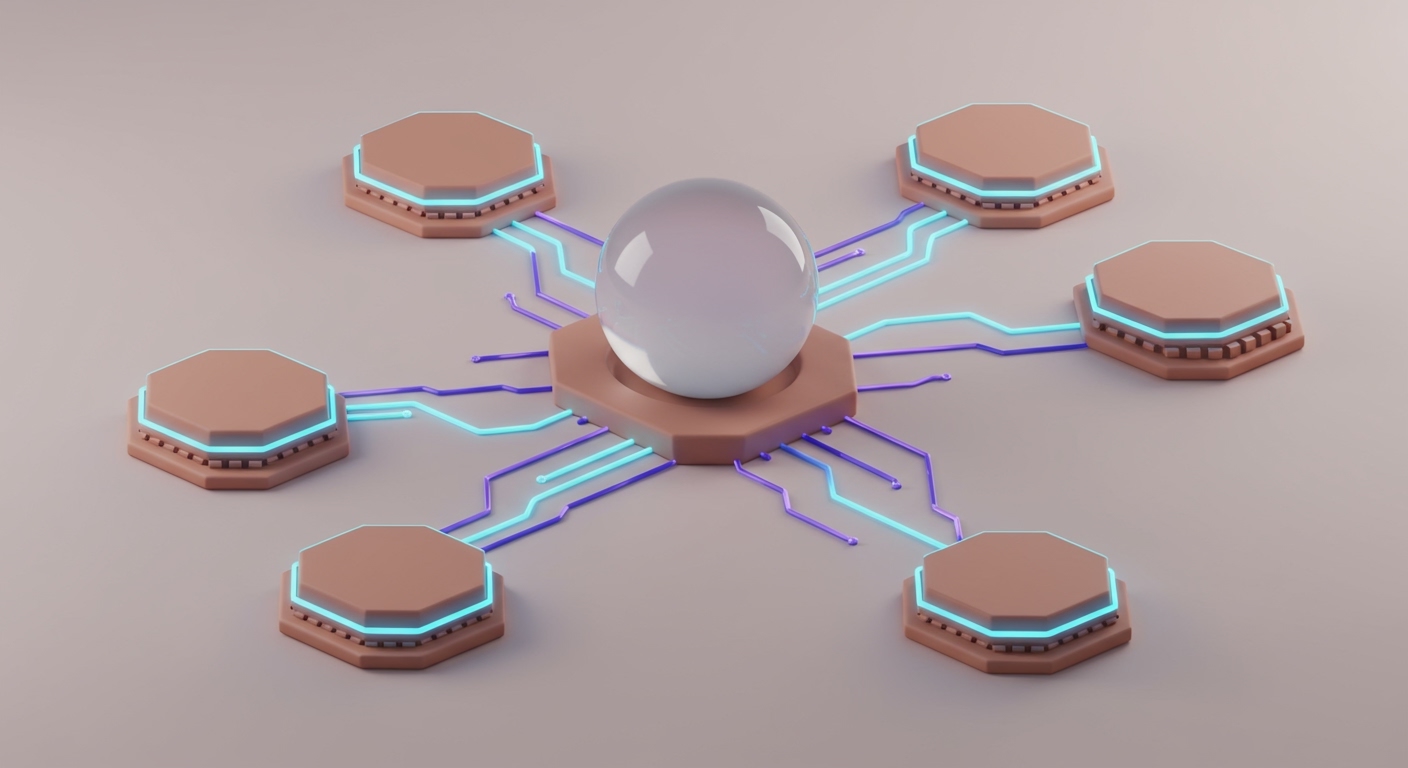

De "vijfde AI-laag" is geen enkele technologie, maar een architectonisch patroon voor het leveren van AI-mogelijkheden als robuuste, schaalbare en veilige toepassingen. Wanneer ik deze systemen op GCP, AWS of Azure architect, is mijn eerste principe het ontkoppelen van de kern AI-inferentiedienst van de rest van de applicatiestack, door deze in te kapselen als een toegewijde microservice.

Hier is een typische uitsplitsing van de architectuur voor productie-AI-systemen:

- Clientapplicatie: De gebruikersgerichte component, of het nu een web-app, mobiele app of een interne bedrijfstool is. Deze initieert verzoeken naar de AI-dienst.

- API Gateway: Alle externe verzoeken moeten via een API Gateway passeren, zoals Apigee, Amazon API Gateway of Azure API Management. Dit is mijn ononderhandelbare beveiligings- en beheerlaag voor het afhandelen van authenticatie, autorisatie, rate limiting en request routing.

- Applicatiebackend: Een standaard microservicelaag die oproepen orkestreert, gegevens uit verschillende bronnen aggregeert en de kernbedrijfslogica bevat. Deze vertaalt clientverzoeken op hoog niveau naar specifieke AI-service-oproepen.

- AI-inferentiedienst: Het hart van de AI-mogelijkheid. Implementeer dit als een gecontaineriseerde dienst, die het getrainde model host en een eenvoudig API-eindpunt voor inferentie blootstelt. Deze dienst moet zeer beschikbaar en schaalbaar zijn, vaak gebruikmakend van GPU-versnelde nodes.

- Gegevensopslagsystemen (Data Stores): Afhankelijk van de use case omvat dit operationele databases voor applicatiestatus, vector databases voor embeddings en datawarehouses voor analyses en feedbackanalyse.

- Event Bus/Queue: Voor asynchrone taken en feedbackloops is een event streaming platform zoals Kafka, GCP Pub/Sub of AWS Kinesis essentieel. Het ontkoppelt langlopende processen van de request-response-cyclus van de gebruiker.

Modelgovernance en -beveiliging

Governance is het meest over het hoofd geziene aspect van modelimplementatie. Voor productieworkloads zijn vertrouwen en compliance niet onderhandelbaar. Hier is mijn checklist:

- Modelsigning: Gebruik tools zoals

SigstoreenCosignom modelartefacten en hun containerimages cryptografisch te ondertekenen. Dit voorkomt manipulatie en biedt een verifieerbare keten van bewijs van de MLOps-pijplijn naar productie. - Kwetsbaarheidsscanning: Scan regelmatig alle modelafhankelijkheden en containerimages op bekende kwetsbaarheden. Gebruik tools zoals

Trivyof de ingebouwde scanners in cloudregisters zoals Google Container Registry (GCR) of Amazon Elastic Container Registry (ECR). - Auditbaarheid & Herkomst (Lineage): Implementeer robuuste logging van alle modelinvoer, uitvoer, voorspellingen en versie-informatie. U moet duidelijke herkomst (lineage) behouden van trainingsgegevens tot het geïmplementeerde model voor naleving van regelgeving (bijv. GDPR, HIPAA) en effectieve debugging.

- Toegangscontrole: Pas strikt IAM-beleid met minimale privileges toe. De inferentiedienst mag alleen de absoluut noodzakelijke machtigingen hebben om toegang te krijgen tot modellen en gegevens.

Dit architectonische fundament onderscheidt een wetenschappelijk project van een productiesysteem. Nu, laten we het realiteit maken.

Implementatiegids

Het implementeren van een AI-applicatie in productie is een systematisch proces. Hier is mijn ervaring met het containeriseren van een AI-model, het implementeren ervan in Kubernetes en het veilig blootstellen ervan.

Stap 1: Containeriseer uw AI-model

Eerst verpakken we het getrainde AI-model en de inferentiecode in een Docker-image. Dit garandeert portabiliteit en consistente uitvoering. Ik raad aan te beginnen met een minimale basisimage zoals python:3.9-slim-buster om de image klein en veilig te houden.

# Dockerfile for AI Inference Service

# Use a lightweight base image for efficiency

FROM python:3.9-slim-buster

WORKDIR /app

# Install dependencies

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

# Copy your model and inference script

COPY model.pkl ./models/model.pkl

COPY inference_app.py .

# Expose the port your application listens on

EXPOSE 8080

# Command to run your application using Gunicorn or equivalent WSGI server

# This assumes your inference_app.py contains a Flask/FastAPI app instance

CMD ["gunicorn", "--bind", "0.0.0.0:8080", "inference_app:app"]

Na het bouwen van de image, pusht u deze naar uw containerregister (bijv. GCR, ECR, Docker Hub).

# Build the Docker image

docker build -t your-org/your-ai-model-image:v1.0 .

# Expected Output:

# Successfully built <image-id>

# Successfully tagged your-org/your-ai-model-image:v1.0

# Authenticate Docker to your registry (example for GCP)

gcloud auth configure-docker

# Tag and push the image to a specific registry path

docker tag your-org/your-ai-model-image:v1.0 gcr.io/your-gcp-project/your-ai-model-image:v1.0

docker push gcr.io/your-gcp-project/your-ai-model-image:v1.0

Stap 2: Implementeer de inferentiedienst in Kubernetes

Vervolgens definiëren we onze deployment in Kubernetes. Dit YAML-bestand vertelt Kubernetes hoe onze container moet worden uitgevoerd, inclusief hoeveel replica's moeten worden gehandhaafd voor hoge beschikbaarheid en welke resources moeten worden toegewezen. Het imagepad moet overeenkomen met degene die u zojuist naar uw register hebt gepusht.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: ai-inference-service

labels:

app: ai-inference

spec:

replicas: 2 # Start with 2 replicas for high availability

selector:

matchLabels:

app: ai-inference

template:

metadata:

labels:

app: ai-inference

spec:

containers:

- name: inference-container

image: gcr.io/your-gcp-project/your-ai-model-image:v1.0 # The image you pushed

ports:

- containerPort: 8080 # The port your AI model listens on

resources:

requests:

cpu: "500m"

memory: "1Gi"

# nvidia.com/gpu: "1" # Correct key for NVIDIA GPUs

limits:

cpu: "1"

memory: "2Gi"

# nvidia.com/gpu: "1" # Correct key for NVIDIA GPUs

env:

- name: MODEL_PATH

value: "/app/models/model.pkl" # Path to your model within the container

livenessProbe:

httpGet:

path: /healthz

port: 8080

initialDelaySeconds: 10

periodSeconds: 5

readinessProbe:

httpGet:

path: /ready

port: 8080

initialDelaySeconds: 15

periodSeconds: 10

Pas deze configuratie toe op uw cluster:

# Apply the deployment configuration

kubectl apply -f ai-inference-deployment.yaml

Verwachte uitvoer:

deployment.apps/ai-inference-service created

Stap 3: Exposeer de dienst via Kubernetes Service en Ingress

Onze pods draaien, maar ze zijn niet toegankelijk van buiten het cluster. We hebben een Service nodig om een stabiel intern eindpunt te bieden en een Ingress om extern verkeer te beheren, SSL-terminatie af te handelen en URL-gebaseerde routing uit te voeren.

# ai-inference-service.yaml

apiVersion: v1

kind: Service

metadata:

name: ai-inference-service-internal

labels:

app: ai-inference

spec:

selector:

app: ai-inference

ports:

- protocol: TCP

port: 80 # Service port

targetPort: 8080 # Container port

type: ClusterIP # Internal service

---

# ai-inference-ingress.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: ai-inference-ingress

annotations:

# Example for NGINX Ingress Controller. Adjust for GCP/AWS/Azure specific ingresses.

nginx.ingress.kubernetes.io/rewrite-target: /

cert-manager.io/cluster-issuer: "letsencrypt-prod" # If using cert-manager for SSL

spec:

tls:

- hosts:

- ai.your-domain.com

secretName: ai-inference-tls # Secret to store SSL certificate

rules:

- host: ai.your-domain.com

http:

paths:

- path: /predict

pathType: Prefix

backend:

service:

name: ai-inference-service-internal

port:

number: 80

Pas deze manifests toe om de netwerkbronnen te creëren:

# Apply the service and ingress configurations

kubectl apply -f ai-inference-service.yaml

kubectl apply -f ai-inference-ingress.yaml

Verwachte uitvoer:

service/ai-inference-service-internal created

ingress.networking.k8s.io/ai-inference-ingress created

Perspectief van een cloudarchitect – Beheerde service vs. Ruwe Kubernetes: Om geavanceerde verkeersroutering (zoals A/B-testen of Canary-releases) en schaal-naar-nul GPU-besparingen af te handelen, implementeer ik speciale serving-frameworks zoals KServe of maak ik gebruik van beheerde eindpunten zoals GCP Vertex AI en AWS SageMaker.

Stap 4: Implementeer een event-driven feedbacklus

Om een model continu te verbeteren, is het vastleggen van gebruikersfeedback of real-world prestatiegegevens cruciaal. Dit proces moet ontkoppeld zijn van de hoofdapplicatiestroom. Een event-driven architectuur is het standaardpatroon om hier te gebruiken.

Stel je een eenvoudig JavaScript-snippet in uw frontend voor waarmee een gebruiker de kwaliteit van een voorspelling kan beoordelen:

// Frontend JavaScript snippet (e.g., in a React/Angular app)

async function submitFeedback(predictionId, userId, rating, details) {

const feedbackData = {

prediction_id: predictionId,

user_id: userId,

rating: rating, // e.g., 1 to 5 stars

details: details,

timestamp: new Date().toISOString()

};

try {

const response = await fetch('https://api.your-domain.com/feedback', {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer ' + getAuthToken() // Securely handle authentication

},

body: JSON.stringify(feedbackData)

});

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

console.log('Feedback submitted successfully!');

} catch (error) {

console.error('Error submitting feedback:', error);

}

}

// Example usage:

// submitFeedback('pred-123', 'user-abc', 5, 'Very accurate!');

Perspectief van een cloudarchitect – De event-driven feedbacklus: De frontend-code legt de feedback vast, maar de echte architectonische uitdaging is het routeren van die gegevens terug naar de model-laag zonder een monolith te creëren. In een bedrijfssysteem komt deze feedbackpayload terecht bij een API Gateway-eindpunt, dat het verzoek valideert en de gebeurtenis publiceert naar een streamingplatform zoals Kafka of GCP Pub/Sub. Dit ontkoppelt de gebruikersgerichte applicatie volledig van de MLOps-pijplijn. Data engineering teams kunnen vervolgens asynchroon deze feedback consumeren, opschonen en aggregeren, waardoor geautomatiseerde modelhertrainingspijplijnen worden geactiveerd wanneer de prestaties afwijken.

Probleemoplossing en verificatie

Eenmaal geïmplementeerd, moet u verifiëren dat alles naar verwachting werkt. Ik gebruik een methodische aanpak, beginnend bij de infrastructuurlaag en vervolgens naar de applicatie.

Verificatiecommando's

- Controleer de Pod-status: Zorg ervoor dat uw inferentiedienstpods gezond zijn en actief draaien.

kubectl get pods -l app=ai-inference

# Expected output:

# NAME READY STATUS RESTARTS AGE

# ai-inference-service-xxxx-yyyy 1/1 Running 0 5m

# ai-inference-service-zzzz-wwww 1/1 Running 0 5m

- Controleer Service & Ingress: Verifieer dat uw netwerk correct is geconfigureerd en dat de Ingress een extern IP-adres heeft.

kubectl get service ai-inference-service-internal

kubectl get ingress ai-inference-ingress

# Expected output for ingress (note the ADDRESS column):

# NAME CLASS HOSTS ADDRESS PORTS AGE

# ai-inference-ingress nginx ai.your-domain.com EXTERNAL_IP 80, 443 5m

- Test het API-eindpunt: Stuur een testverzoek naar het publieke eindpunt van uw dienst.

# Replace ai.your-domain.com with your actual ingress host

# and provide a sample payload expected by your model

curl -X POST -H "Content-Type: application/json" \

-d '{"features": [1.2, 3.4, 5.6]}' \

https://ai.your-domain.com/predict

# Expected output:

# {"prediction": "class_A", "confidence": 0.95}

Veelvoorkomende fouten en oplossingen

-

Fout:

ImagePullBackOff- Symptoom: Pods starten niet met deze status.

- Oorzaak: Kubernetes kan uw Docker-image niet pullen. Dit komt meestal door een typefout in de imagenamen/tag in uw

deployment.yaml, het niet bestaan van de image in het register, of het ontbreken van machtigingen voor het cluster om toegang te krijgen tot een privéregister. - Oplossing: Controleer het

image:-pad in uw YAML. Zorg ervoor dat de image en tag bestaan. Als het register privé is, bevestig dan dat eenimagePullSecretcorrect is geconfigureerd of dat de IAM-rol van de node de juiste machtigingen heeft.

-

Fout:

CrashLoopBackOff- Symptoom: Pods starten, crashen dan onmiddellijk en herstarten in een lus.

- Oorzaak: Uw applicatie in de container faalt. Veelvoorkomende redenen zijn een ontbrekende omgevingsvariabele, een onjuist bestandspad naar het model, een bug in de opstartcode of een ontbrekende afhankelijkheid.

- Oplossing: Inspecteer de containerlogs. Dit is uw belangrijkste diagnostische hulpmiddel.

kubectl logs ai-inference-service-xxxx-yyyy # Replace with your actual pod name

# Look for Python tracebacks or other specific error messages.

- Fout:

502 Bad Gatewayvan Ingress- Symptoom:

curl-verzoeken naar uw publieke URL falen met een 502-fout. - Oorzaak: De Ingress-controller kan niet communiceren met uw dienst. Dit is bijna altijd een mismatch tussen labels of poorten.

- Oplossing: Controleer of de

service.nameenservice.port.numberin uwIngress-manifest overeenkomen met demetadata.nameenspec.ports.portin uwService-manifest. Verifieer vervolgens of detargetPortin deServiceovereenkomt met decontainerPortin uwDeployment.

- Symptoom:

De FinOps-realiteit van AI-infrastructuur

Orkestratie gaat niet alleen over prestaties; het gaat over kostenbeheersing. Een veelvoorkomende en dure fout die ik zie, is ongebruikte GPU-uitgaven. Een high-density GPU-cluster zelfs maar een paar uur idle laten, kan duizenden dollars kosten. Compromisloze automatisering is de enige oplossing.

- Automatiseer schaal-naar-nul: Voor ontwikkelings- en staging-omgevingen moeten Kubernetes-node pools worden geconfigureerd om naar nul nodes te schalen wanneer ze niet in gebruik zijn. Productieworkloads moeten automatisch schalen op basis van real-time vraag.

- Capaciteitsplanning is niet onderhandelbaar: Het reserveren van honderden A100- of H100-GPU's vereist aanzienlijke kapitaaluitgaven of langetermijncloudverbintenissen. Strenge FinOps-governance en capaciteitsplanning zijn essentieel voordat die meerjarige contracten worden ondertekend.

Voor een diepere analyse van dit onderwerp, zie mijn analyse van de cloud FinOps-sector: Technische analyse van de cloud FinOps-sector.

Conclusie: Het beheersen van de laatste mijl

De "vijfde AI-laag" is waar de aanzienlijke investering in de ontwikkeling van AI-modellen eindelijk zijn vruchten afwerpt. Het is niet genoeg om een briljant model te hebben; u moet het operationaliseren binnen een veilige, schaalbare en geïntegreerde applicatie die tastbare bedrijfswaarde levert. Dit vereist een verschuiving in focus van pure data science naar robuuste software- en systeemengineering.

Als ik 30 seconden had om een CTO mijn mening hierover te geven, zou het dit zijn: "Uw AI-investeringen lopen risico als u de applicatielaag niet beheerst. Zonder naadloze integratie in uw bestaande bedrijfssystemen en een duidelijk pad voor gebruikersfeedback, zullen zelfs de meest geavanceerde modellen geen ROI leveren. Het draait allemaal om de 'laatste mijl' levering, niet alleen om het model zelf."

Belangrijkste leerpunten

- Integratie is cruciaal: Uw AI-applicatie moet veilig integreren met bestaande identiteits-, gegevens- en workflowsystemen. Dit is niet optioneel.

- Ontkoppel met Microservices: Scheid uw AI-inferentielogica van uw bedrijfslogica met behulp van API's. Dit is fundamenteel voor het bereiken van schaalbaarheid en onderhoudbaarheid.

- Bouw feedbackloops: Implementeer asynchrone, event-driven mechanismen voor het vastleggen van prestatiegegevens en gebruikersfeedback om continue verbetering te stimuleren.

- Beheer en beveilig alles: Modelsigning, kwetsbaarheidsscanning en robuuste audit trails zijn niet onderhandelbaar voor elk AI-systeem in productie.

- Beheers uw kosten: Idle GPU's zijn een architectonische mislukking. Gebruik autoscaling en schaal-naar-nul om ervoor te zorgen dat dure middelen nooit worden verspild.

Verder lezen en bronnen

- Officiële Kubernetes-voorbeelden: Voor meer implementatiepatronen, raadpleeg de officiële Kubernetes-voorbeelden repository.

- KServe Project: Voor geavanceerde, beheerde model serving op Kubernetes, bekijk het KServe project.

- Cloud API Gateway Voorbeelden: Voor voorbeelden van het beveiligen van eindpunten, zie de AWS API Gateway voorbeelden.