Prerequisiti

Quando si ascoltano le aziende parlare delle loro ambizioni in fatto di IA, c'è spesso un profondo fascino per i modelli e gli algoritmi, ma un punto cieco comune per la pura potenza industriale necessaria per far funzionare questi sistemi. La sfida non è solo costruire software intelligente; è progettare le strutture fisiche, la robusta rete e la sofisticata orchestrazione necessarie per operare l'IA su una scala paragonabile a un servizio di pubblica utilità nazionale. Stiamo parlando di una rete globale di potenza di calcolo specializzata, non solo di una fattura astratta da un fornitore di servizi cloud.

Questo articolo analizza questo cruciale terzo strato dell'IA — i data center e i servizi cloud — e dimostra come costruire un'infrastruttura in grado di supportare l'IA su scala industriale. Il mio obiettivo è demistificare i componenti fondamentali e condividere le migliori pratiche da implementazioni reali, trattando l'IA non come magia, ma come il potente servizio di pubblica utilità che sta diventando.

Per seguire gli esempi concreti, avrete bisogno del toolkit standard per le implementazioni Azure di livello di produzione. Lavorare con le ultime versioni stabili garantisce compatibilità e accesso a funzionalità critiche.

- Azure CLI: Versione

2.58.0o successiva. Questo è il mio strumento di riferimento per tutte le interazioni programmatiche con Azure. Verificate la vostra versione conaz --version. - Terraform CLI: Versione

1.7.0o successiva. Per l'infrastruttura come codice, Terraform è indispensabile per creare ambienti ripetibili e con controllo di versione. Verificate conterraform version. kubectlCLI: Versione1.29o successiva. Questo è lo standard universale per la gestione dei cluster Kubernetes. Verificate conkubectl version --client.- Sottoscrizione Azure: Avrete bisogno di una sottoscrizione attiva con i permessi per creare risorse, inclusi cluster Kubernetes, reti virtuali e istanze Front Door. Tutti i miei esempi useranno regioni europee come

westeuropeenortheurope.

Architettura: La rete di servizi di pubblica utilità per l'intelligenza

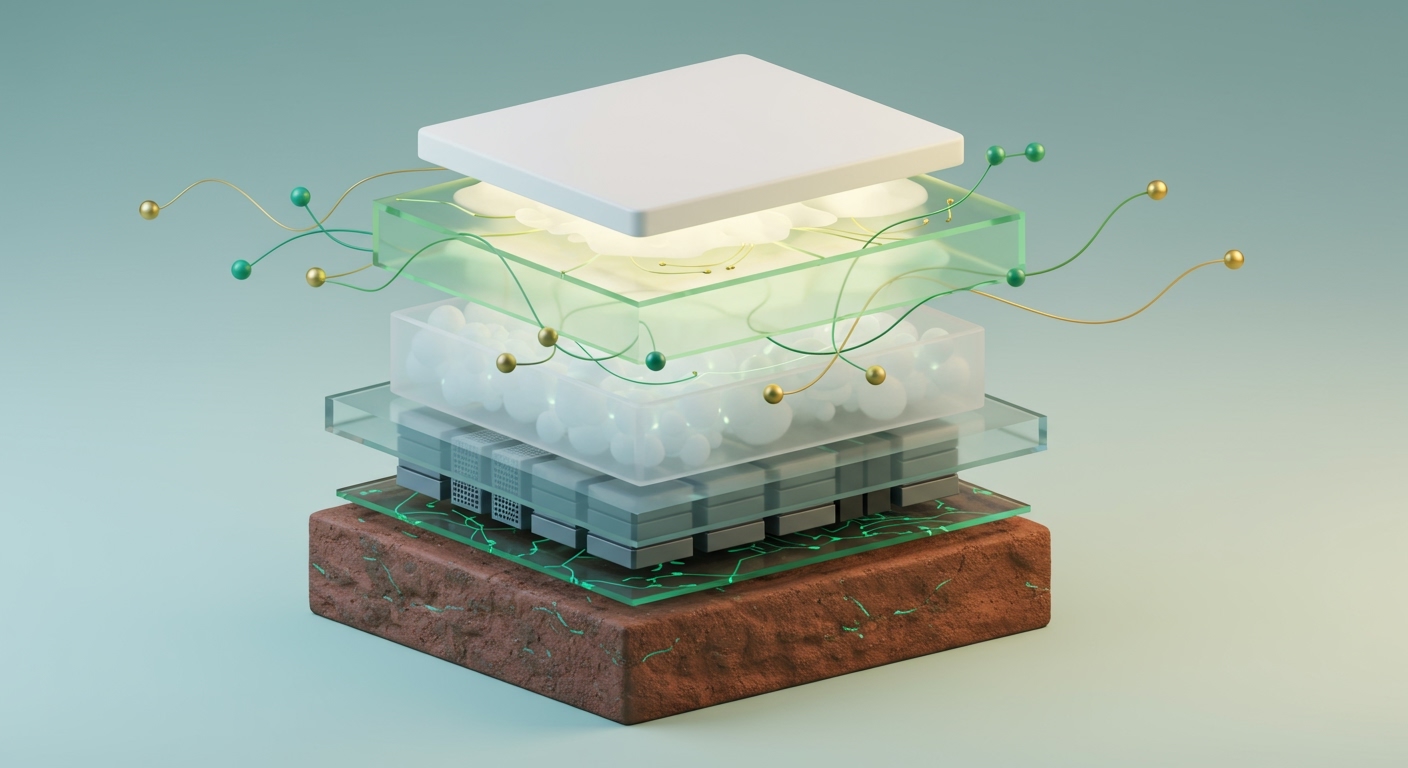

Lo strato industriale dell'IA è meglio compreso trattando la potenza di calcolo come un servizio di pubblica utilità. Proprio come una centrale elettrica genera elettricità che scorre attraverso una rete verso case e fabbriche, i data center generano calcolo IA che scorre attraverso reti globali verso le applicazioni. Molte organizzazioni sottovalutano le sfide fisiche e logistiche. Non si tratta di avviare qualche VM; si tratta di ottimizzare potenza, raffreddamento, interconnettività di rete e sicurezza su una scala massiccia e implacabile.

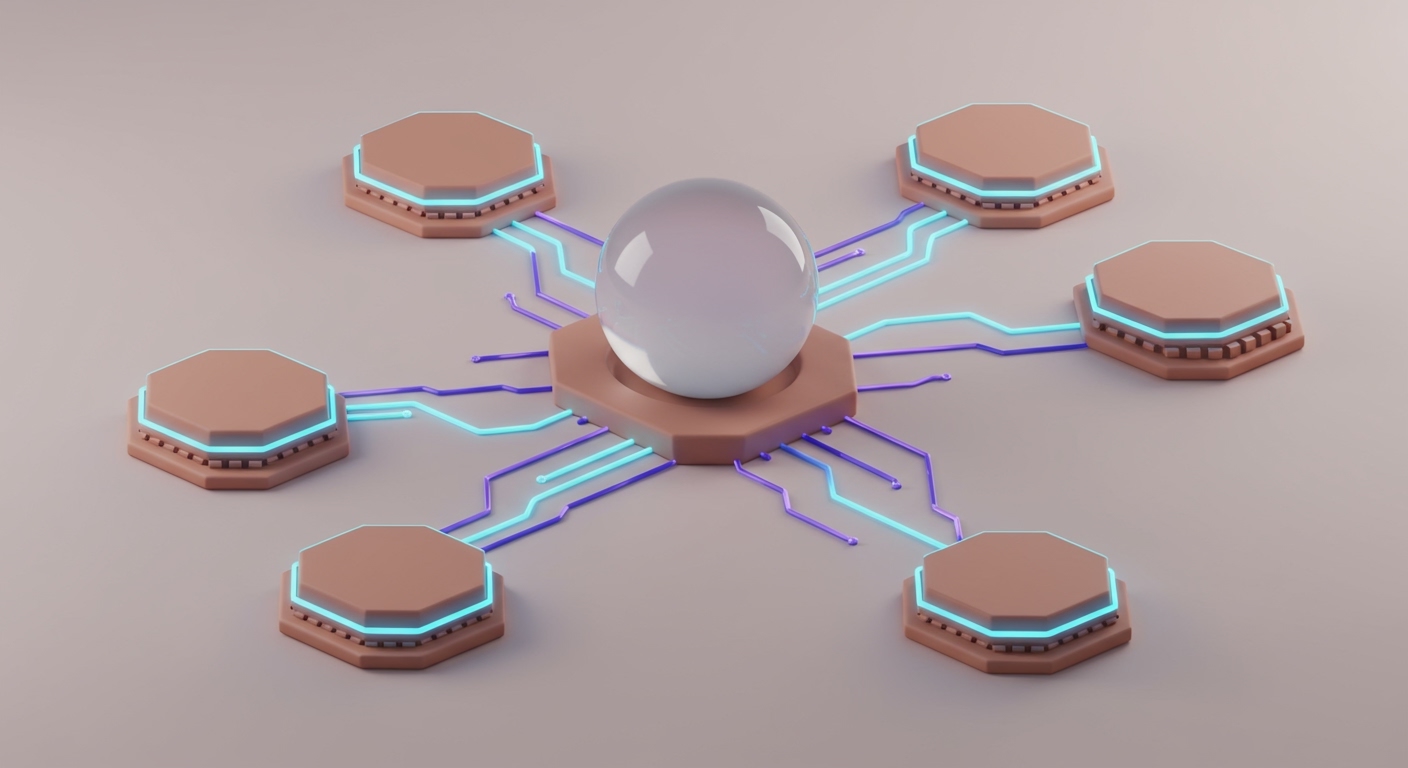

Al centro di questo strato ci sono i moderni data center gestiti da fornitori di servizi cloud come Microsoft Azure, Amazon o Google. Queste strutture ospitano vaste schiere di hardware specializzato — in particolare GPU — interconnesse da reti ad alta larghezza di banda e bassa latenza. I servizi cloud astraggono questa complessità fisica, offrendo calcolo scalabile (come Azure Kubernetes Service per carichi di lavoro GPU), networking intelligente (Azure Front Door per la gestione del traffico globale) e orchestrazione robusta (Azure Functions, Durable Functions e Service Bus).

La realtà fisica dietro il cloud

Quando si visitano i data center, la scala è sbalorditiva. Il ronzio di migliaia di server, l'enorme volume d'aria spostato da massicci sistemi di raffreddamento e gli infiniti rack di fibre ottiche meticolosamente cablate — questo è il fondamento fisico dell'IA. Per ogni modello che gira nel cloud, c'è una corrispondente spesa di elettricità e un'impronta fisica tangibile. Questa realtà è alla base dell'intero terzo strato e ha significative implicazioni FinOps (ovvero monetarie).

Questo approccio componibile, in cui costruiamo l'IA utilizzando servizi interconnessi e specializzati, è la chiave. Invece di sistemi monolitici, sfruttiamo API standard per l'interoperabilità, che è la nostra migliore difesa contro il vendor lock-in.

Componenti Architettonici Chiave

Per un sistema IA su scala industriale, mi concentro su quattro pilastri principali:

-

Cluster di calcolo ad alte prestazioni: Qui avviene il lavoro pesante dell'addestramento e dell'inferenza dell'IA. La scelta è spesso un servizio Kubernetes gestito come Azure Kubernetes Service (AKS) che gira su macchine virtuali abilitate per GPU (scriverò presto sulle GPU serverless). Fornisce l'orchestrazione necessaria per distribuire, scalare e gestire i carichi di lavoro IA containerizzati senza il sovraccarico di gestire il piano di controllo.

-

Networking globale e distribuzione Edge: Le applicazioni IA devono essere veloci e reattive, indipendentemente dalla posizione dell'utente. Utilizzare servizi come Azure Front Door o la rete globale di Cloudflare come punto di ingresso intelligente. Gestiscono la terminazione TLS, il caching, la protezione DDoS e l'instradamento efficiente del traffico verso il backend sano più vicino. Questo è un elemento non negoziabile per minimizzare la latenza.

-

Archiviazione e gestione dei dati: I carichi di lavoro IA sono "data-hungry". Ciò richiede una strategia di archiviazione multi-sfaccettata: archiviazione oggetti (Azure Blob Storage) per grandi set di dati e artefatti di modelli, database vettoriali specializzati per i pattern di Retrieval-Augmented Generation (RAG) e database tradizionali per lo stato dell'applicazione. Le pipeline di dati robuste sono il sistema circolatorio che li collega tutti.

-

Orchestrazione e automazione: Oltre al calcolo di base, l'orchestrazione di complessi workflow IA è critica. Ciò implica l'uso di componenti serverless come Azure Functions o funzioni Google Cloud Run per compiti stateless (ad esempio, il pre-processing di una richiesta API) e Durable Functions per workflow stateful a lunga esecuzione. I servizi di messaggistica come Azure Service Bus forniscono il "collante" duraturo e asincrono tra questi microservizi.

Ecco un diagramma che mostra come questi elementi interagiscono per formare uno strato IA industriale coeso.

Governance e sicurezza dei modelli

Per qualsiasi carico di lavoro di produzione, la governance e la sicurezza dei modelli non sono facoltative. Questa è una checklist di base per garantire l'integrità, la verificabilità e l'uso responsabile dei modelli IA su larga scala:

- Controllo di versione: I modelli sono artefatti software. Devono essere versionati in un registro dedicato, come quello in Azure Machine Learning, per consentire rollback e cronologie di deployment verificabili.

- Controllo degli accessi rigoroso: Utilizzate criteri IAM granulari per controllare chi può accedere, distribuire e richiamare i modelli. Il principio del privilegio minimo è fondamentale.

- Registrazione di audit completa: Registrate ogni invocazione del modello, inclusi i dati di input (o il loro hash), l'output e l'identità del chiamante. Ciò è essenziale per la tracciabilità e la conformità.

- Endpoint sicuri: Tutti i modelli devono essere distribuiti dietro un gateway API sicuro che imponga autenticazione, autorizzazione e limitazione di frequenza.

- Crittografia dei dati: Tutti i dati, sia in transito sulla rete che a riposo nell'archiviazione, devono essere crittografati utilizzando chiavi robuste e gestite.

Con questa blueprint architettonica in mente, gettiamo le basi della nostra infrastruttura: il cluster di calcolo.

Esempio di Codice: Terraform per un cluster AKS abilitato per GPU

Questa configurazione Terraform provvede a un cluster Azure Kubernetes Service (AKS) con un node pool dedicato per macchine abilitate per GPU in westeurope. Questo è il blocco di calcolo fondamentale per la nostra implementazione IA industriale.

# main.tf

# Configure the Azure provider to a European region

provider "azurerm" {

features {}

# Using 'westeurope' as our primary region for compute resources.

# For HA systems, we'd deploy to multiple European regions.

}

resource "azurerm_resource_group" "ai_infra_rg" {

name = "ai-compute-rg-production-eu"

location = "westeurope"

}

resource "azurerm_kubernetes_cluster" "ai_aks_cluster" {

name = "ai-industrial-aks-eu-01"

location = azurerm_resource_group.ai_infra_rg.location

resource_group_name = azurerm_resource_group.ai_infra_rg.name

dns_prefix = "ai-aks-eu"

kubernetes_version = "1.29.4" # Align with current stable AKS versions

default_node_pool {

name = "systempool"

node_count = 2

vm_size = "Standard_DS2_v2"

os_disk_size_gb = 30

auto_scaling_enabled = true

min_count = 1

max_count = 3

}

identity {

type = "SystemAssigned"

}

network_profile {

network_plugin = "azure"

load_balancer_sku = "standard"

service_cidr = "10.0.0.0/16"

dns_service_ip = "10.0.0.10"

docker_bridge_cidr = "172.17.0.1/16"

}

tags = {

"project" = "AIIndustrialScale"

"environment" = "Production"

}

}

# Dedicated node pool for GPU workloads, critical for industrial AI scale.

# This uses 'Standard_NC6s_v3' with NVIDIA V100 GPUs.

resource "azurerm_kubernetes_cluster_node_pool" "ai_gpu_node_pool" {

name = "gpunodepool"

kubernetes_cluster_id = azurerm_kubernetes_cluster.ai_aks_cluster.id

vm_size = "Standard_NC6s_v3"

node_count = 0 # Start with 0 and scale as needed to manage costs

os_disk_size_gb = 60

auto_scaling_enabled = true

min_count = 0

max_count = 5 # Scale up to 5 GPU nodes based on demand

node_labels = {

"agentpool" = "gpunodepool"

"gpu" = "nvidia-v100"

}

tags = {

"environment" = "production"

"ai_layer" = "industrial"

}

}

output "kubernetes_cluster_name" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.name

description = "The name of the Kubernetes cluster."

}

output "kubernetes_cluster_id" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.id

description = "The ID of the Kubernetes cluster."

}

Guida all'implementazione

Costruire lo strato IA industriale è un processo metodico. Suddividete il lavoro in: messa in sicurezza del calcolo centrale, creazione della portata di rete globale e quindi deployment dei carichi di lavoro IA. Ogni passaggio si concentra sulla creazione di un'infrastruttura robusta e scalabile, adatta per operazioni su scala di servizio pubblico.

1. Provisioning del cluster AKS abilitato per GPU

Innanzitutto, distribuiremo il cluster di calcolo fondamentale utilizzando la configurazione Terraform sopra.

# Initialize Terraform in your project directory

terraform init

# Review the planned changes before applying

terraform plan -out=aks_gpu_plan.tfplan

# Apply the Terraform configuration to provision resources

terraform apply "aks_gpu_plan.tfplan"

Dopo alcuni minuti, Terraform completerà il processo e vedrete gli output che confermano la creazione del cluster.

Output atteso:

Apply complete! Resources: 3 added, 0 changed, 0 destroyed.

Outputs:

kubernetes_cluster_id = "/subscriptions/<your-subscription-id>/resourceGroups/ai-compute-rg-production-eu/providers/Microsoft.ContainerService/managedClusters/ai-industrial-aks-eu-01"

kubernetes_cluster_name = "ai-industrial-aks-eu-01"

Questo conferma che il vostro cluster AKS, con il suo node pool GPU pronto per la scalabilità, è stato distribuito con successo in westeurope.

2. Configurare l'accesso a `kubectl

Una volta che il cluster è attivo, è necessario configurare il client

kubectl` locale per interagirvi. L'Azure CLI semplifica questo processo recuperando le credenziali del cluster.

# Get AKS cluster credentials (using admin for simplicity, use user auth in production)

az aks get-credentials --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --overwrite-existing --admin

# Verify kubectl connectivity by listing nodes

kubectl get nodes

Output atteso:

Merged "ai-industrial-aks-eu-01-admin" as current context in /home/mark/.kube/config.

NAME STATUS ROLES AGE VERSION

aks-systempool-12345678-vmss000000 Ready agent 5m v1.29.4

aks-systempool-12345678-vmss000001 Ready agent 5m v1.29.4

Si noti che i nodi del gpunodepool non sono ancora elencati. Questo perché abbiamo impostato il node_count iniziale a 0. Saranno provisionati dall'autoscaler del cluster una volta che un carico di lavoro richiederà risorse GPU.

3. Deployment di un carico di lavoro di inferenza IA sui nodi GPU

Ora, distribuiamo un servizio di inferenza IA di esempio. Questo manifesto di Deployment Kubernetes istruisce lo scheduler ad eseguire il nostro contenitore su un nodo abilitato per GPU, collegando il nostro strato di orchestrazione all'hardware specializzato.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: gpu-inference-app

labels:

app: gpu-inference

spec:

replicas: 1

selector:

matchLabels:

app: gpu-inference

template:

metadata:

labels:

app: gpu-inference

spec:

# Node affinity ensures this workload runs only on a node with the specified GPU.

nodeSelector:

gpu: "nvidia-v100"

containers:

- name: inference-container

# In a real scenario, you'd use your custom AI model image.

# This public image is a base with CUDA drivers installed.

image: "mcr.microsoft.com/azureml/intelmpi2018.3-cuda10.0-cudnn7-ubuntu16.04:20191010.v1"

resources:

limits:

nvidia.com/gpu: 1 # Request 1 GPU from the node

ports:

- containerPort: 80

---

apiVersion: v1

kind: Service

metadata:

name: gpu-inference-service

spec:

selector:

app: gpu-inference

ports:

- protocol: TCP

port: 80

targetPort: 80

type: LoadBalancer # Expose the service with a public IP via Azure Load Balancer

Applicate questa configurazione al vostro cluster:

# Apply the Kubernetes deployment and service

kubectl apply -f ai-inference-deployment.yaml

Output atteso:

deployment.apps/gpu-inference-app created

service/gpu-inference-service created

Questo attiva l'autoscaler di AKS. Vedrà un pod che richiede una GPU, noterà che non ci sono nodi disponibili e inizierà a provisionare un nuovo nodo nel gpunodepool.

4. Configurazione della rete globale Edge con Azure Front Door

Per rendere il nostro servizio IA accessibile globalmente con bassa latenza, posizioniamo un bilanciatore di carico globale come Azure Front Door di fronte ad esso. Sebbene la configurazione completa di Terraform sia estesa, questo snippet concettuale mostra le risorse chiave.

# networking.tf (conceptual)

# A Web Application Firewall (WAF) policy is a prerequisite for Front Door.

resource "azurerm_cdn_frontdoor_firewall_policy" "ai_waf_policy" {

name = "ai-app-waf-policy"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

enabled = true

mode = "Prevention"

}

# The Front Door profile is the top-level resource.

resource "azurerm_cdn_frontdoor_profile" "ai_afd_profile" {

name = "ai-global-frontdoor-profile"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

}

# An endpoint provides the public-facing hostname.

resource "azurerm_cdn_frontdoor_endpoint" "ai_afd_endpoint" {

name = "ai-endpoint-eu-prod-unique"

cdn_frontdoor_profile_id = azurerm_cdn_frontdoor_profile.ai_afd_profile.id

}

# In a complete configuration, you would also define:

# 1. An Origin Group pointing to the public IP of the 'gpu-inference-service'.

# 2. A Route to connect the public endpoint to the origin group.

# 3. A Security Policy to associate the WAF policy with the endpoint.

Questa configurazione sfrutta la rete edge globale di Microsoft. Una richiesta dell'utente colpisce il Punto di Presenza (PoP) più vicino, che quindi la instrada efficientemente tramite la dorsale privata di Microsoft al nostro servizio di inferenza in westeurope, fornendo un'esperienza veloce e sicura.

Risoluzione dei problemi e verifica

Garantire che la vostra infrastruttura IA industriale sia robusta richiede una verifica approfondita. Secondo la mia esperienza, la maggior parte dei problemi deriva da configurazioni errate nel networking, nei permessi IAM o nell'allocazione delle risorse.

Comandi di verifica

- Verificare lo stato del cluster AKS:

az aks show --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --query "provisioningState"

**Output atteso:** `"Succeeded"`

- Verificare la presenza di nodi GPU (dopo il deployment del pod):

kubectl get nodes --selector=gpu=nvidia-v100

**Output atteso (dopo l'autoscaling):**

NAME STATUS ROLES AGE VERSION

aks-gpunodepool-12345678-vmss000000 Ready agent 10m v1.29.4

- Verificare lo stato del pod di inferenza IA:

kubectl get pod -l app=gpu-inference

**Output atteso:** `STATUS` dovrebbe essere `Running`.

- Ottenere l'IP esterno del servizio di inferenza:

kubectl get service gpu-inference-service

**Output atteso:** Il campo `EXTERNAL-IP` mostrerà un indirizzo IP pubblico dopo pochi minuti. Questo è l'IP che configurate nella vostra origine Front Door.

Errori comuni e soluzioni

-

Errore: Pod bloccato nello stato

Pendingcon avviso di risorsanvidia.com/gpu.- Sintomo:

kubectl describe pod <pod-name>mostra un evento comeFailedScheduling... 0/3 nodes are available: 3 Insufficient nvidia.com/gpu. - Soluzione: Questo è previsto inizialmente. L'autoscaler del cluster dovrebbe provisionare un nuovo nodo GPU. Se impiega più di 5-10 minuti, controllate i diagnostici AKS per errori dell'autoscaler. Inoltre, verificate che il vostro

nodeSelectornel YAML di deployment corrisponda esattamente ainode_labelsnella vostra configurazione Terraform.

- Sintomo:

-

Errore: Il

EXTERNAL-IPdel servizio rimane<pending>per molto tempo.- Soluzione: Questo di solito significa che l'Azure Load Balancer sta impiegando tempo per provisionare un IP pubblico. Se persiste oltre 15 minuti, controllate i log di attività del gruppo di risorse per eventuali fallimenti di provisioning. Potrebbe anche indicare che avete raggiunto una quota di indirizzi IP pubblici nella vostra sottoscrizione.

-

Avviso FinOps: Costi GPU inattivi

- Sintomo: La vostra fattura cloud mostra costi elevati per le VM GPU, ma le metriche di utilizzo sono basse.

- Soluzione: Questo è un classico problema FinOps. Assicuratevi che il vostro autoscaler del cluster sia configurato correttamente non solo per scalare, ma anche per scalare verso il basso. Impostate

min_count = 0sui node pool costosi che non sono sempre necessari. Monitorate attentamente lo scheduling dei pod e l'utilizzo dei nodi per assicurarvi di non pagare per hardware inattivo e costoso.

Conclusione e prossimi passi

Il terzo strato dell'IA — la spina dorsale industriale dei data center e dei servizi cloud — è dove avviene il vero lavoro. È l'infrastruttura critica che trasforma modelli potenti in servizi di pubblica utilità scalabili, affidabili e globali. Come architetto, sottolineo costantemente che trascurare queste fondamenta è come costruire un grattacielo sulla sabbia. Il successo dell'IA su larga scala dipende interamente dall'infrastruttura robusta e globale che distribuiamo.

Adottare una mentalità da servizio di pubblica utilità

La metafora dell'«IA come servizio di pubblica utilità» non è solo concettuale; deve dettare le nostre scelte architettoniche. Progettiamo per la resilienza, la scalabilità e l'efficienza, proprio come farebbe un operatore di rete elettrica. Questo include tutto, dai progetti di data center efficienti dal punto di vista energetico alla scalabilità automatizzata dei cluster GPU e al networking distribuito geograficamente. Le implicazioni finanziarie sono anche profonde, richiedendo una rigorosa strategia FinOps per gestire i considerevoli costi operativi.

Punti chiave

- Le fondamenta fisiche contano: Il "cloud" IA è un'infrastruttura fisica massiccia che richiede un'attenta pianificazione per potenza, raffreddamento e connettività.

- L'orchestrazione è fondamentale: Kubernetes gestito (come AKS con nodi GPU) è cruciale per il deployment e la gestione efficiente dei carichi di lavoro IA.

- Il networking globale non è negoziabile: Le reti edge e i bilanciatori di carico globali (come Azure Front Door) sono essenziali per servizi IA a bassa latenza e alta disponibilità.

- L'infrastruttura come codice è obbligatoria: Strumenti come Terraform sono vitali per deployment di infrastruttura ripetibili, coerenti e con controllo di versione.

Risorse del repository

Il codice completo e specifico per il progetto di un'architettura così complessa è tipicamente conservato in repository client privati. Tuttavia, la documentazione ufficiale e gli esempi pubblici di seguito sono eccellenti punti di partenza per ogni componente.

- Azure Quickstart Templates for AKS: `https://github.com/Azure/azure-quickstart-templates/tree/master/quickstarts/microsoft.containerservice/aks

* **Terraform Azure Provider Examples:**

https://github.com/hashicorp/terraform-provider-azurerm/tree/main/examples

* **Advanced Azure ML Examples:**

https://github.com/Azure/azureml-examples

* **Kubernetes Documentation:**

https://kubernetes.io/docs/home/`