Prerequisiti

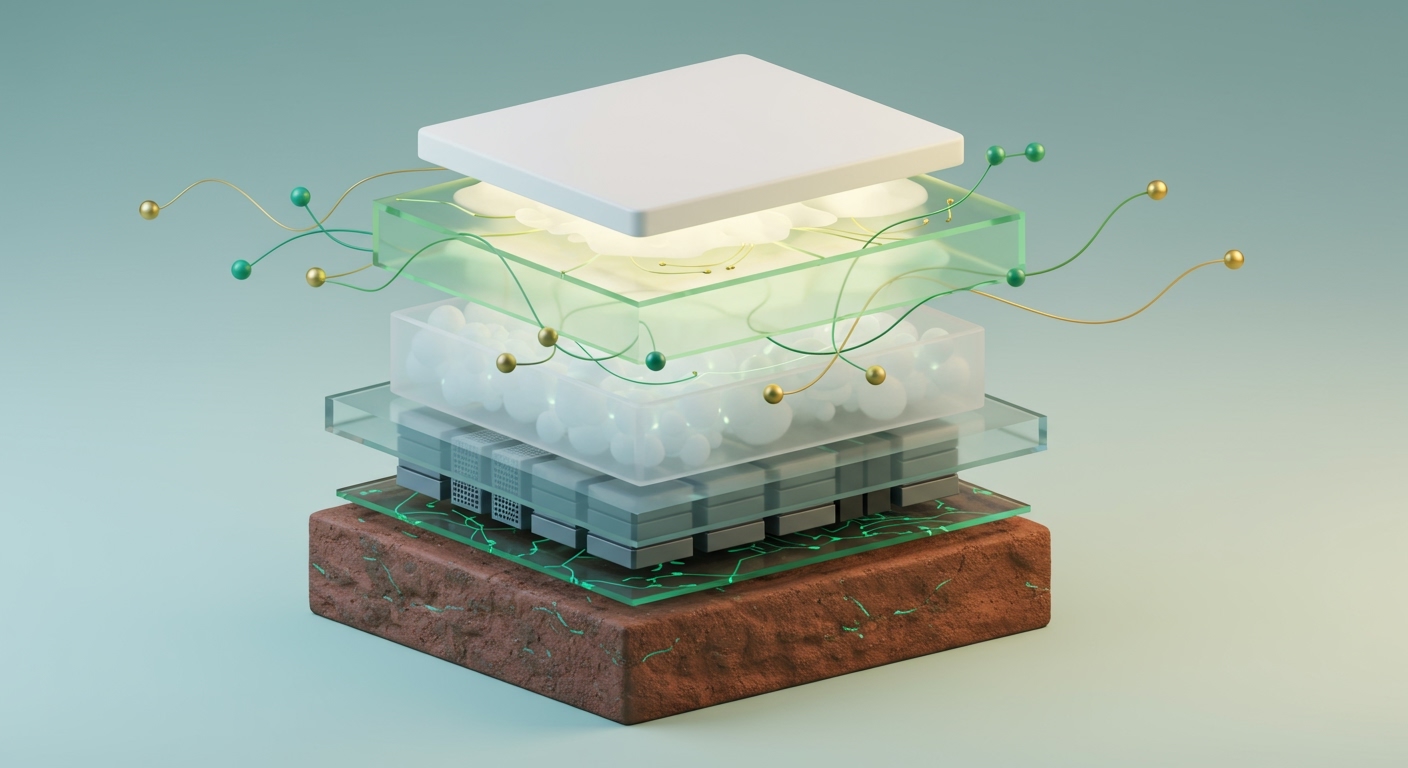

Il quinto strato dell'AI: dove i modelli incontrano la realtà e il ROI

Nelle iniziative di AI, il collo di bottiglia è raramente l'algoritmo in sé. Esistono innumerevoli organizzazioni che investono pesantemente negli strati fondamentali dell'AI—acquisendo GPU all'avanguardia, costruendo enormi data lake e addestrando modelli sofisticati. Tuttavia, un errore comune e costoso emerge quando è il momento di realizzare il ritorno effettivo su tale investimento: lo strato applicativo. Questo è l'"ultimo miglio" dell'AI, dove il potere teorico di un modello deve integrarsi senza soluzione di continuità nei flussi di lavoro aziendali esistenti, nei sistemi sicuri e nelle esperienze utente.

Modelli brillanti rimangono inutilizzati perché non sono riusciti a integrarsi in modo sicuro con database legacy come SAP o EHR Oracle, non hanno soddisfatto i requisiti di conformità o semplicemente non sono riusciti a scalare per gestire la domanda degli utenti. La sfida non è solo far funzionare un modello di AI; si tratta di farlo funzionare nel mondo reale per fornire un beneficio economico misurabile.

Lo strato applicativo è l'"ultimo miglio" dell'intelligenza artificiale — ed è l'unico strato che genera un ritorno sull'investimento (ROI). Se un'applicazione AI non riesce a integrarsi in modo sicuro con i provider di identità aziendali esistenti (IAM), i database legacy (SAP, Oracle, EHR ospedalieri) e i flussi di lavoro degli utenti, l'enorme spesa in conto capitale per GPU e l'addestramento dei modelli è interamente sprecata.

Questa guida è un approccio collaudato sul campo per architettare e implementare applicazioni AI che colmano questa lacuna. Esamineremo le considerazioni critiche per la costruzione di questo "Quinto strato AI" e per trasformare i modelli in valore.

Prima di iniziare a implementare applicazioni AI, è fondamentale disporre del giusto set di strumenti e delle conoscenze fondamentali. Consiglio sempre ai miei clienti di standardizzare su una moderna piattaforma di orchestrazione di container e di avere i loro strumenti cloud principali pronti. Per gli esempi che seguiranno, darò per scontato che abbiate una familiarità operativa con:

- Containerizzazione:

Docker Engine(versione24.0o successiva). - Kubernetes: Un cluster in esecuzione e un client

kubectlconfigurato (versione1.28o successiva). - CLI del provider cloud: La CLI

gcloud,awsoaz, a seconda del cloud scelto. - Python 3.9+: Per lo sviluppo della logica applicativa e delle interazioni API.

- Fondamenti di networking: Una solida comprensione di load balancing, ingress controller e service mesh.

Architettura: il progetto per l'AI nel mondo reale

Il "Quinto strato AI" non è una singola tecnologia ma un modello architettonico per fornire capacità AI come applicazioni robuste, scalabili e sicure. Quando progetto questi sistemi su GCP, AWS o Azure, il mio primo principio è quello di disaccoppiare il servizio di inferenza AI principale dal resto dello stack applicativo, incapsulandolo come un microservizio dedicato.

Ecco una tipica scomposizione dell'architettura per i sistemi AI di produzione:

- Applicazione client: Il componente rivolto all'utente, che sia un'app web, un'app mobile o uno strumento aziendale interno. Avvia le richieste al servizio AI.

- API Gateway: Tutte le richieste esterne devono passare attraverso un API Gateway come Apigee, Amazon API Gateway o Azure API Management. Questo è il mio strato di sicurezza e gestione non negoziabile per la gestione dell'autenticazione, dell'autorizzazione, del rate limiting e del routing delle richieste.

- Backend dell'applicazione: Uno strato di microservizi standard che orchestra le chiamate, aggrega dati da varie fonti e contiene la logica di business principale. Traduce le richieste client di alto livello in chiamate specifiche al servizio AI.

- Servizio di inferenza AI: Il cuore della capacità AI. Distribuirlo come un servizio containerizzato, ospitando il modello addestrato ed esponendo un semplice endpoint API per l'inferenza. Questo servizio deve essere altamente disponibile e scalabile, spesso sfruttando nodi accelerati da GPU.

- Data Store: A seconda del caso d'uso, questo include database operativi per lo stato dell'applicazione, database vettoriali per gli embedding e data warehouse per l'analisi e l'analisi del feedback.

- Event Bus/Coda: Per attività asincrone e cicli di feedback, una piattaforma di streaming di eventi come Kafka, GCP Pub/Sub o AWS Kinesis è essenziale. Disaccoppia i processi a lunga esecuzione dal ciclo di richiesta-risposta dell'utente.

Governance e sicurezza del modello

La governance è l'aspetto più frequentemente trascurato dell'implementazione del modello. Per i carichi di lavoro di produzione, fiducia e conformità non sono negoziabili. Ecco la mia checklist:

- Firma del modello: Utilizzare strumenti come

SigstoreeCosignper firmare crittograficamente gli artefatti del modello e le loro immagini container. Ciò previene le manomissioni e fornisce una catena di custodia verificabile dalla pipeline MLOps alla produzione. - Scansione delle vulnerabilità: Scansionare regolarmente tutte le dipendenze del modello e le immagini container per vulnerabilità note. Utilizzare strumenti come

Trivyo gli scanner integrati nei registri cloud come Google Container Registry (GCR) o Amazon Elastic Container Registry (ECR). - Auditabilità e provenienza: Implementare un logging robusto di tutti gli input, output, previsioni e informazioni sulla versione del modello. È necessario mantenere una chiara provenienza dai dati di training al modello distribuito per la conformità normativa (ad esempio, GDPR, HIPAA) e un debugging efficace.

- Controllo degli accessi: Applicare politiche IAM rigorose e con il privilegio minimo. Il servizio di inferenza dovrebbe avere solo le autorizzazioni di cui ha assolutamente bisogno per accedere ai modelli e ai dati.

Questa base architettonica è ciò che separa un progetto scientifico da un sistema di livello produttivo. Ora, rendiamolo reale.

Guida all'implementazione

L'implementazione di un'applicazione AI in produzione è un processo sistematico. Ecco la mia esperienza nel containerizzare un modello AI, implementarlo su Kubernetes ed esporlo in modo sicuro.

Passaggio 1: Containerizzare il modello AI

Innanzitutto, impacchettiamo il modello AI addestrato e il suo codice di inferenza in un'immagine Docker. Questo garantisce portabilità ed esecuzione coerente. Consiglio di iniziare con un'immagine base minimale come python:3.9-slim-buster per mantenere l'immagine piccola e sicura.

# Dockerfile for AI Inference Service

# Use a lightweight base image for efficiency

FROM python:3.9-slim-buster

WORKDIR /app

# Install dependencies

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

# Copy your model and inference script

COPY model.pkl ./models/model.pkl

COPY inference_app.py .

# Expose the port your application listens on

EXPOSE 8080

# Command to run your application using Gunicorn or equivalent WSGI server

# This assumes your inference_app.py contains a Flask/FastAPI app instance

CMD ["gunicorn", "--bind", "0.0.0.0:8080", "inference_app:app"]

Dopo aver creato l'immagine, la invierai al tuo registro di container (ad esempio, GCR, ECR, Docker Hub).

# Build the Docker image

docker build -t your-org/your-ai-model-image:v1.0 .

# Expected Output:

# Successfully built <image-id>

# Successfully tagged your-org/your-ai-model-image:v1.0

# Authenticate Docker to your registry (example for GCP)

gcloud auth configure-docker

# Tag and push the image to a specific registry path

docker tag your-org/your-ai-model-image:v1.0 gcr.io/your-gcp-project/your-ai-model-image:v1.0

docker push gcr.io/your-gcp-project/your-ai-model-image:v1.0

Passaggio 2: Implementare il servizio di inferenza su Kubernetes

Successivamente, definiremo la nostra implementazione in Kubernetes. Questo file YAML indica a Kubernetes come eseguire il nostro container, incluso quante repliche mantenere per l'alta disponibilità e quali risorse allocare. Il percorso dell'immagine dovrebbe corrispondere a quello appena inviato al tuo registro.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: ai-inference-service

labels:

app: ai-inference

spec:

replicas: 2 # Start with 2 replicas for high availability

selector:

matchLabels:

app: ai-inference

template:

metadata:

labels:

app: ai-inference

spec:

containers:

- name: inference-container

image: gcr.io/your-gcp-project/your-ai-model-image:v1.0 # The image you pushed

ports:

- containerPort: 8080 # The port your AI model listens on

resources:

requests:

cpu: "500m"

memory: "1Gi"

# nvidia.com/gpu: "1" # Correct key for NVIDIA GPUs

limits:

cpu: "1"

memory: "2Gi"

# nvidia.com/gpu: "1" # Correct key for NVIDIA GPUs

env:

- name: MODEL_PATH

value: "/app/models/model.pkl" # Path to your model within the container

livenessProbe:

httpGet:

path: /healthz

port: 8080

initialDelaySeconds: 10

periodSeconds: 5

readinessProbe:

httpGet:

path: /ready

port: 8080

initialDelaySeconds: 15

periodSeconds: 10

Applica questa configurazione al tuo cluster:

# Apply the deployment configuration

kubectl apply -f ai-inference-deployment.yaml

Output atteso:

deployment.apps/ai-inference-service created

Passaggio 3: Esporre il servizio tramite Kubernetes Service e Ingress

I nostri pod sono in esecuzione, ma non sono accessibili dall'esterno del cluster. Abbiamo bisogno di un Service per fornire un endpoint interno stabile e di un Ingress per gestire il traffico esterno, gestire la terminazione SSL ed eseguire il routing basato su URL.

# ai-inference-service.yaml

apiVersion: v1

kind: Service

metadata:

name: ai-inference-service-internal

labels:

app: ai-inference

spec:

selector:

app: ai-inference

ports:

- protocol: TCP

port: 80 # Service port

targetPort: 8080 # Container port

type: ClusterIP # Internal service

---

# ai-inference-ingress.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: ai-inference-ingress

annotations:

# Example for NGINX Ingress Controller. Adjust for GCP/AWS/Azure specific ingresses.

nginx.ingress.kubernetes.io/rewrite-target: /

cert-manager.io/cluster-issuer: "letsencrypt-prod" # If using cert-manager for SSL

spec:

tls:

- hosts:

- ai.your-domain.com

secretName: ai-inference-tls # Secret to store SSL certificate

rules:

- host: ai.your-domain.com

http:

paths:

- path: /predict

pathType: Prefix

backend:

service:

name: ai-inference-service-internal

port:

number: 80

Applica questi manifest per creare le risorse di networking:

# Apply the service and ingress configurations

kubectl apply -f ai-inference-service.yaml

kubectl apply -f ai-inference-ingress.yaml

Output atteso:

service/ai-inference-service-internal created

ingress.networking.k8s.io/ai-inference-ingress created

Prospettiva dell'Architetto Cloud — Serving gestito vs. Kubernetes puro: Per gestire il routing avanzato del traffico (come A/B testing o Canary releases) e i risparmi GPU con scale-to-zero, implemento framework di serving dedicati come KServe o utilizzo endpoint gestiti come GCP Vertex AI e AWS SageMaker.

Passaggio 4: Implementare un ciclo di feedback basato su eventi

Per migliorare continuamente un modello, è fondamentale acquisire il feedback degli utenti o i dati sulle prestazioni nel mondo reale. Questo processo deve essere disaccoppiato dal flusso applicativo principale. Un'architettura basata su eventi è il modello standard da utilizzare qui.

Immagina un semplice snippet JavaScript nel tuo frontend che consente a un utente di valutare la qualità di una previsione:

// Frontend JavaScript snippet (e.g., in a React/Angular app)

async function submitFeedback(predictionId, userId, rating, details) {

const feedbackData = {

prediction_id: predictionId,

user_id: userId,

rating: rating, // e.g., 1 to 5 stars

details: details,

timestamp: new Date().toISOString()

};

try {

const response = await fetch('https://api.your-domain.com/feedback', {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer ' + getAuthToken() // Securely handle authentication

},

body: JSON.stringify(feedbackData)

});

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

console.log('Feedback submitted successfully!');

} catch (error) {

console.error('Error submitting feedback:', error);

}

}

// Example usage:

// submitFeedback('pred-123', 'user-abc', 5, 'Very accurate!');

Prospettiva dell'Architetto Cloud — Il ciclo di feedback basato su eventi: Il codice frontend cattura il feedback, ma la vera sfida architettonica è reindirizzare tali dati allo strato del modello senza creare un monolite. In un sistema aziendale, questo payload di feedback raggiunge un endpoint API Gateway, che convalida la richiesta e pubblica l'evento su una piattaforma di streaming come Kafka o GCP Pub/Sub. Ciò disaccoppia completamente l'applicazione rivolta all'utente dalla pipeline MLOps. I team di ingegneria dei dati possono quindi consumare, sanificare e aggregare questo feedback in modo asincrono, attivando pipeline di riaddestramento automatico del modello quando le prestazioni deviano.

Risoluzione dei problemi e verifica

Una volta implementato, è necessario verificare che tutto funzioni come previsto. Utilizzo un approccio metodico, partendo dallo strato infrastrutturale e risalendo all'applicazione.

Comandi di verifica

- Verificare lo stato dei pod: Assicurarsi che i pod del servizio di inferenza siano integri e in esecuzione.

kubectl get pods -l app=ai-inference

# Expected output:

# NAME READY STATUS RESTARTS AGE

# ai-inference-service-xxxx-yyyy 1/1 Running 0 5m

# ai-inference-service-zzzz-wwww 1/1 Running 0 5m

- Verificare il servizio e l'Ingress: Verificare che la rete sia configurata correttamente e che l'Ingress abbia un indirizzo IP esterno.

kubectl get service ai-inference-service-internal

kubectl get ingress ai-inference-ingress

# Expected output for ingress (note the ADDRESS column):

# NAME CLASS HOSTS ADDRESS PORTS AGE

# ai-inference-ingress nginx ai.your-domain.com EXTERNAL_IP 80, 443 5m

- Testare l'endpoint API: Inviare una richiesta di test all'endpoint pubblico del servizio.

# Replace ai.your-domain.com with your actual ingress host

# and provide a sample payload expected by your model

curl -X POST -H "Content-Type: application/json" \

-d '{"features": [1.2, 3.4, 5.6]}' \

https://ai.your-domain.com/predict

# Expected output:

# {"prediction": "class_A", "confidence": 0.95}

Errori comuni e soluzioni

-

Errore:

ImagePullBackOff- Sintomo: I pod non riescono ad avviarsi con questo stato.

- Causa: Kubernetes non riesce a tirare la tua immagine Docker. Questo è solitamente dovuto a un errore di battitura nel nome/tag dell'immagine nel tuo

deployment.yaml, all'immagine che non esiste nel registro, o al cluster che manca di permessi per accedere a un registro privato. - Soluzione: Ricontrolla il percorso

image:nel tuo YAML. Assicurati che l'immagine e il tag esistano. Se il registro è privato, conferma che unimagePullSecretsia configurato correttamente o che il ruolo IAM del nodo abbia i permessi.

-

Errore:

CrashLoopBackOff- Sintomo: I pod si avviano, poi si bloccano immediatamente e si riavviano in un ciclo.

- Causa: La tua applicazione all'interno del container sta fallendo. Le ragioni comuni includono una variabile d'ambiente mancante, un percorso errato del file del modello, un bug nel codice di avvio o una dipendenza mancante.

- Soluzione: Ispeziona i log del container. Questo è il tuo strumento diagnostico più importante.

kubectl logs ai-inference-service-xxxx-yyyy # Replace with your actual pod name

# Look for Python tracebacks or other specific error messages.

- Errore:

502 Bad Gatewaydall'Ingress- Sintomo: Le richieste

curlal tuo URL pubblico falliscono con un errore 502. - Causa: Il controller Ingress non riesce a comunicare con il tuo servizio. Questo è quasi sempre una discrepanza tra etichette o porte.

- Soluzione: Controlla che

service.nameeservice.port.numbernel tuo manifestIngresscorrispondano ametadata.nameespec.ports.portnel tuo manifestService. Poi, verifica chetargetPortnelServicecorrisponda acontainerPortnel tuoDeployment.

- Sintomo: Le richieste

La realtà FinOps dell'infrastruttura AI

L'orchestrazione non riguarda solo le prestazioni; riguarda il controllo dei costi. Un fallimento comune e costoso che vedo è la spesa per GPU inattive. Lasciare un cluster GPU ad alta densità inattivo, anche per poche ore, può bruciare migliaia di dollari. Un'automazione spietata è l'unica soluzione.

- Automazione Scale-to-Zero: Per gli ambienti di sviluppo e staging, i pool di nodi Kubernetes dovrebbero essere configurati per scalare fino a zero nodi quando non in uso. I carichi di lavoro di produzione dovrebbero scalare automaticamente in base alla domanda in tempo reale.

- La pianificazione della capacità non è negoziabile: Riservare centinaia di GPU A100 o H100 richiede una spesa in conto capitale significativa o impegni cloud a lungo termine. Una rigorosa governance FinOps e una pianificazione della capacità sono essenziali prima di firmare quei contratti pluriennali.

Per un'analisi più approfondita di questo argomento, consulta la mia analisi del settore FinOps del cloud: Technical Analysis of the Cloud FinOps Sector.

Conclusione: padroneggiare l'ultimo miglio

Il "Quinto strato AI" è dove l'investimento sostanziale nello sviluppo di modelli AI ripaga finalmente. Non è sufficiente avere un modello brillante; è necessario renderlo operativo all'interno di un'applicazione sicura, scalabile e integrata che offra un valore aziendale tangibile. Ciò richiede uno spostamento di attenzione dalla pura scienza dei dati a una robusta ingegneria del software e dei sistemi.

Se avessi 30 secondi per dare a un CTO la mia opinione su questo, sarebbe questa: "I vostri investimenti in AI sono a rischio se non padroneggiate lo strato applicativo. Senza un'integrazione senza soluzione di continuità nei vostri sistemi aziendali esistenti e un percorso chiaro per il feedback degli utenti, anche i modelli più avanzati non riusciranno a fornire un ROI. Si tratta tutta della consegna dell''ultimo miglio', non solo del modello in sé."

Punti chiave

- L'integrazione è fondamentale: La tua applicazione AI deve integrarsi in modo sicuro con i sistemi di identità, dati e flussi di lavoro esistenti. Questo non è opzionale.

- Disaccoppiare con i Microservizi: Separare la logica di inferenza AI dalla logica di business utilizzando le API. Questo è fondamentale per raggiungere scalabilità e manutenibilità.

- Costruire cicli di feedback: Implementare meccanismi asincroni, basati su eventi per acquisire dati sulle prestazioni e feedback degli utenti per guidare il miglioramento continuo.

- Governare e proteggere tutto: La firma del modello, la scansione delle vulnerabilità e robusti audit trail non sono negoziabili per qualsiasi sistema AI in produzione.

- Controllare i costi: Le GPU inattive sono un fallimento architetturale. Utilizzare l'autoscaling e lo scale-to-zero per garantire che le risorse costose non vengano mai sprecate.

Ulteriori letture e risorse

- Esempi ufficiali di Kubernetes: Per ulteriori modelli di implementazione, fare riferimento al repository ufficiale degli esempi di Kubernetes.

- Progetto KServe: Per un serving di modelli avanzato e gestito su Kubernetes, consultare il progetto KServe.

- Esempi di Cloud API Gateway: Per esempi di protezione degli endpoint, consultare gli esempi di AWS API Gateway.