Prérequis

Lorsque vous écoutez les entreprises parler de leurs ambitions en matière d'IA, il y a souvent une fascination profonde pour les modèles et les algorithmes, mais un angle mort courant quant à la puissance industrielle colossale requise pour faire fonctionner ces systèmes. Le défi n'est pas seulement de construire des logiciels intelligents ; il s'agit d'architecturer les installations physiques, les réseaux robustes et l'orchestration sophistiquée nécessaires pour opérer l'IA à une échelle comparable à celle d'un service public national. Nous parlons d'un réseau mondial de puissance de calcul spécialisée, et pas seulement d'une facture abstraite d'un fournisseur de services cloud.

Cet article analyse cette troisième couche cruciale de l'IA – les centres de données et les services cloud – et démontre comment construire une infrastructure capable de supporter l'IA à l'échelle industrielle. Mon objectif est de démystifier les composants fondamentaux et de partager les meilleures pratiques issues de déploiements réels, traitant l'IA non pas comme de la magie, mais comme le puissant service public qu'elle est en train de devenir.

Pour suivre les exemples concrets, vous aurez besoin de la boîte à outils standard pour les déploiements Azure de niveau production. Travailler avec les dernières versions stables garantit la compatibilité et l'accès aux fonctionnalités critiques.

- Azure CLI : Version

2.58.0ou ultérieure. C'est mon outil de prédilection pour toute interaction programmatique avec Azure. Vérifiez votre version avecaz --version. - Terraform CLI : Version

1.7.0ou ultérieure. Pour l'infrastructure en tant que code, Terraform est indispensable pour créer des environnements reproductibles et versionnés. Vérifiez avecterraform version. kubectlCLI : Version1.29ou ultérieure. C'est le standard universel pour la gestion des clusters Kubernetes. Vérifiez aveckubectl version --client.- Abonnement Azure : Vous aurez besoin d'un abonnement actif avec les autorisations nécessaires pour créer des ressources, y compris des clusters Kubernetes, des réseaux virtuels et des instances Front Door. Tous mes exemples utiliseront des régions européennes comme

westeuropeetnortheurope.

Architecture : La grille de services publics pour l'intelligence

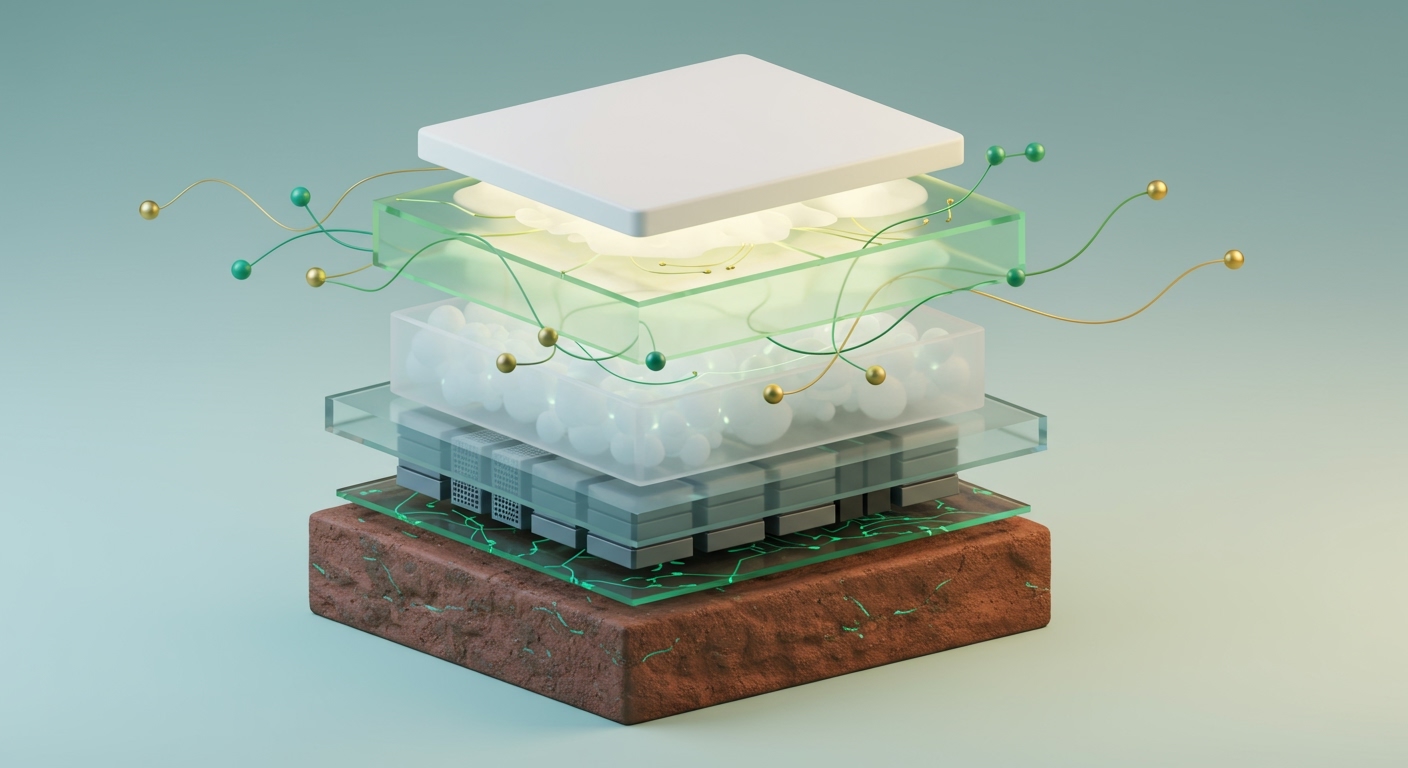

La couche industrielle de l'IA est mieux comprise en traitant la puissance de calcul comme un service public. Tout comme une centrale électrique génère de l'électricité qui circule sur un réseau vers les foyers et les usines, les centres de données génèrent du calcul IA qui transite via des réseaux mondiaux vers les applications. De nombreuses organisations sous-estiment les défis physiques et logistiques. Il ne s'agit pas de lancer quelques machines virtuelles (VM) ; il s'agit de l'optimisation de l'alimentation électrique, du refroidissement, de l'interconnectivité réseau et de la sécurité à une échelle massive et implacable.

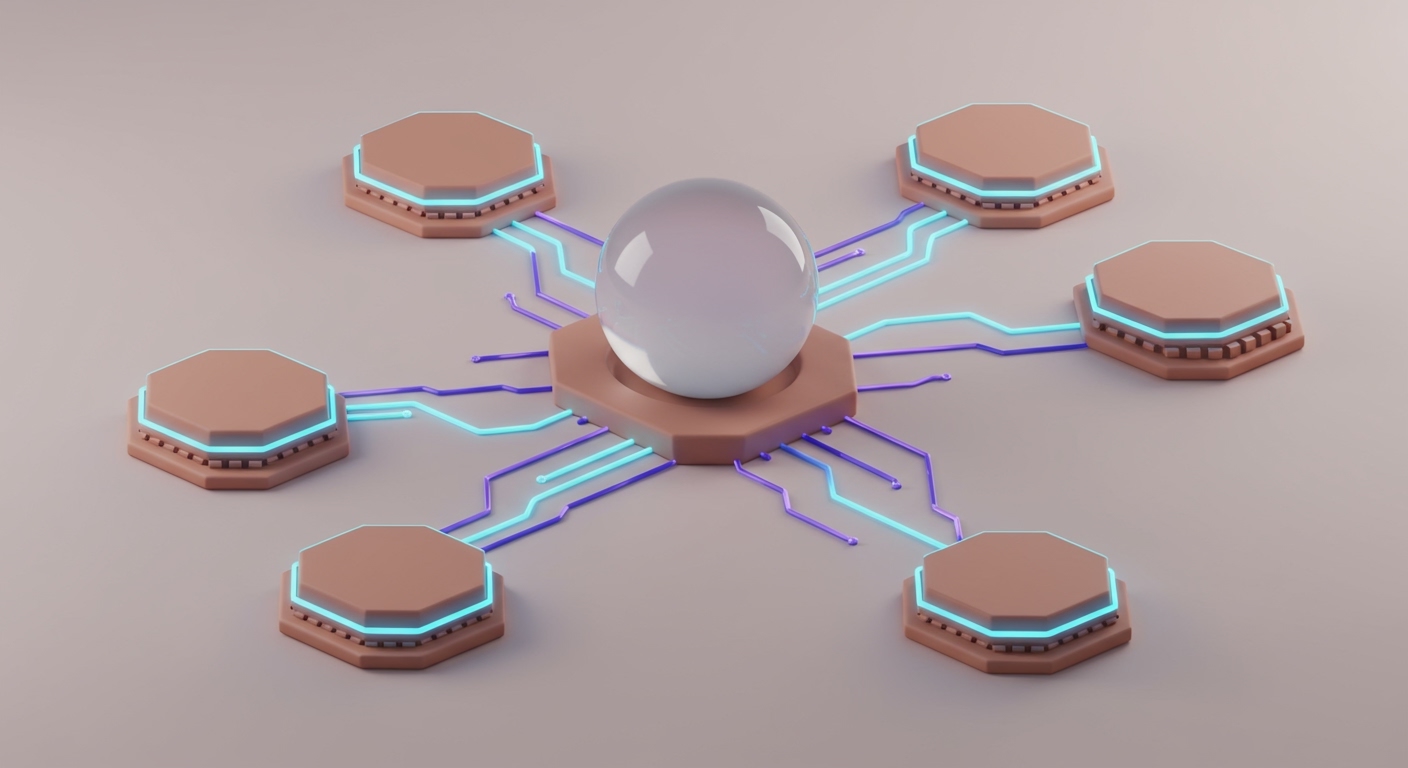

Au cœur de cette couche se trouvent les centres de données modernes exploités par des fournisseurs de services cloud comme Microsoft Azure, Amazon ou Google. Ces installations abritent de vastes ensembles de matériel spécialisé – en particulier des GPU – interconnectés par des réseaux à haute bande passante et à faible latence. Les services cloud abstrait cette complexité physique, offrant un calcul évolutif (comme Azure Kubernetes Service pour les charges de travail GPU), une mise en réseau intelligente (Azure Front Door pour la gestion globale du trafic) et une orchestration robuste (Azure Functions, Durable Functions et Service Bus).

La réalité physique derrière le cloud

Lorsque vous parcourez les centres de données, l'échelle est stupéfiante. Le bourdonnement de milliers de serveurs, le volume d'air colossal déplacé par d'énormes systèmes de refroidissement, et les innombrables racks de fibres optiques méticuleusement câblées – voilà le socle physique de l'IA. Pour chaque modèle exécuté dans le cloud, il y a une dépense correspondante d'électricité et une empreinte physique tangible. Cette réalité sous-tend l'ensemble de la troisième couche et a des implications FinOps (c'est-à-dire financières) importantes.

Cette approche composable, où nous construisons l'IA à l'aide de services interconnectés et spécialisés, est la clé. Au lieu de systèmes monolithiques, nous tirons parti d'APIs standard pour l'interopérabilité, ce qui est notre meilleure défense contre le verrouillage propriétaire (vendor lock-in).

Composants architecturaux clés

Pour un système d'IA à l'échelle industrielle, je me concentre sur quatre piliers principaux :

-

Clusters de calcul haute performance : C'est là que se déroule le gros du travail d'entraînement et d'inférence de l'IA. Le choix est souvent un service Kubernetes géré comme Azure Kubernetes Service (AKS) exécuté sur des machines virtuelles dotées de GPU (j'écrirai bientôt sur les GPU sans serveur). Il fournit l'orchestration nécessaire au déploiement, à la mise à l'échelle et à la gestion des charges de travail d'IA conteneurisées sans la surcharge de gestion du plan de contrôle.

-

Mise en réseau globale et livraison en périphérie : Les applications d'IA doivent être rapides et réactives, quel que soit l'emplacement de l'utilisateur. Utilisez des services comme Azure Front Door ou le réseau mondial de Cloudflare comme point d'entrée intelligent. Ils gèrent la terminaison TLS, la mise en cache, la protection DDoS et l'acheminement efficace du trafic vers le backend sain le plus proche. Ceci est non négociable pour minimiser la latence.

-

Stockage et gestion des données : Les charges de travail d'IA sont gourmandes en données. Cela nécessite une stratégie de stockage multifacette : stockage d'objets (Azure Blob Storage) pour les grands ensembles de données et les artefacts de modèles, bases de données vectorielles spécialisées pour les modèles de génération augmentée par récupération (RAG), et bases de données traditionnelles pour l'état des applications. Des pipelines de données robustes sont le système circulatoire qui les connecte tous.

-

Orchestration et automatisation : Au-delà du calcul de base, l'orchestration de workflows d'IA complexes est essentielle. Cela implique l'utilisation de composants sans serveur comme Azure Functions ou Google Cloud Run functions pour les tâches sans état (par exemple, le prétraitement d'une requête API) et de Durable Functions pour les workflows avec état, à longue durée d'exécution. Les services de messagerie comme Azure Service Bus fournissent la colle durable et asynchrone entre ces microservices.

Voici un diagramme montrant comment ces éléments interagissent pour former une couche d'IA industrielle cohérente.

Gouvernance et sécurité des modèles

Pour toute charge de travail en production, la gouvernance et la sécurité des modèles ne sont pas facultatives. Voici une liste de contrôle de base pour garantir l'intégrité, l'auditabilité et l'utilisation responsable des modèles d'IA à grande échelle :

- Contrôle de version : Les modèles sont des artefacts logiciels. Ils doivent être versionnés dans un registre dédié, comme celui d'Azure Machine Learning, pour permettre les retours en arrière et les historiques de déploiement auditables.

- Contrôle d'accès strict : Utilisez des politiques IAM à grain fin pour contrôler qui peut accéder, déployer et invoquer des modèles. Le principe du moindre privilège est primordial.

- Journalisation d'audit complète : Enregistrez chaque invocation de modèle, y compris les données d'entrée (ou leur hachage), la sortie et l'identité de l'appelant. Ceci est essentiel pour la traçabilité et la conformité.

- Points de terminaison sécurisés : Tous les modèles doivent être déployés derrière une passerelle API sécurisée qui applique l'authentification, l'autorisation et la limitation de débit.

- Chiffrement des données : Toutes les données, qu'elles soient en transit sur le réseau ou au repos dans le stockage, doivent être chiffrées à l'aide de clés fortes et gérées.

Avec ce plan architectural en tête, posons la première pierre de notre fondation : le cluster de calcul.

Exemple de code : Terraform pour un cluster AKS activé par GPU

Cette configuration Terraform provisionne un cluster Azure Kubernetes Service (AKS) avec un pool de nœuds dédié pour les machines dotées de GPU dans westeurope. C'est le bloc de calcul fondamental pour notre déploiement d'IA industrielle.

# main.tf

# Configure the Azure provider to a European region

provider "azurerm" {

features {}

# Using 'westeurope' as our primary region for compute resources.

# For HA systems, we'd deploy to multiple European regions.

}

resource "azurerm_resource_group" "ai_infra_rg" {

name = "ai-compute-rg-production-eu"

location = "westeurope"

}

resource "azurerm_kubernetes_cluster" "ai_aks_cluster" {

name = "ai-industrial-aks-eu-01"

location = azurerm_resource_group.ai_infra_rg.location

resource_group_name = azurerm_resource_group.ai_infra_rg.name

dns_prefix = "ai-aks-eu"

kubernetes_version = "1.29.4" # Align with current stable AKS versions

default_node_pool {

name = "systempool"

node_count = 2

vm_size = "Standard_DS2_v2"

os_disk_size_gb = 30

auto_scaling_enabled = true

min_count = 1

max_count = 3

}

identity {

type = "SystemAssigned"

}

network_profile {

network_plugin = "azure"

load_balancer_sku = "standard"

service_cidr = "10.0.0.0/16"

dns_service_ip = "10.0.0.10"

docker_bridge_cidr = "172.17.0.1/16"

}

tags = {

"project" = "AIIndustrialScale"

"environment" = "Production"

}

}

# Dedicated node pool for GPU workloads, critical for industrial AI scale.

# This uses 'Standard_NC6s_v3' with NVIDIA V100 GPUs.

resource "azurerm_kubernetes_cluster_node_pool" "ai_gpu_node_pool" {

name = "gpunodepool"

kubernetes_cluster_id = azurerm_kubernetes_cluster.ai_aks_cluster.id

vm_size = "Standard_NC6s_v3"

node_count = 0 # Start with 0 and scale as needed to manage costs

os_disk_size_gb = 60

auto_scaling_enabled = true

min_count = 0

max_count = 5 # Scale up to 5 GPU nodes based on demand

node_labels = {

"agentpool" = "gpunodepool"

"gpu" = "nvidia-v100"

}

tags = {

"environment" = "production"

"ai_layer" = "industrial"

}

}

output "kubernetes_cluster_name" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.name

description = "Le nom du cluster Kubernetes."

}

output "kubernetes_cluster_id" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.id

description = "L'ID du cluster Kubernetes."

}

Guide d'implémentation

La construction de la couche d'IA industrielle est un processus méthodique. Décomposez-le en sécurisant le calcul central, en établissant une portée réseau mondiale, puis en déployant les charges de travail d'IA. Chaque étape se concentre sur la création d'une infrastructure robuste et évolutive adaptée aux opérations à l'échelle d'un service public.

1. Provisionnement du cluster AKS activé par GPU

Nous allons d'abord déployer le cluster de calcul fondamental en utilisant la configuration Terraform ci-dessus.

# Initialize Terraform in your project directory

terraform init

# Review the planned changes before applying

terraform plan -out=aks_gpu_plan.tfplan

# Apply the Terraform configuration to provision resources

terraform apply "aks_gpu_plan.tfplan"

Après quelques minutes, Terraform se terminera et vous verrez les sorties confirmant la création du cluster.

Sortie attendue :

Apply complete! Resources: 3 added, 0 changed, 0 destroyed.

Outputs:

kubernetes_cluster_id = "/subscriptions/<your-subscription-id>/resourceGroups/ai-compute-rg-production-eu/providers/Microsoft.ContainerService/managedClusters/ai-industrial-aks-eu-01"

kubernetes_cluster_name = "ai-industrial-aks-eu-01"

Ceci confirme que votre cluster AKS, avec son pool de nœuds GPU prêt pour la mise à l'échelle, a été déployé avec succès dans westeurope.

2. Configurer l'accès `kubectl

Une fois le cluster opérationnel, vous devez configurer votre client

kubectl` local pour interagir avec lui. L'Azure CLI simplifie cette tâche en récupérant les informations d'identification du cluster.

# Get AKS cluster credentials (using admin for simplicity, use user auth in production)

az aks get-credentials --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --overwrite-existing --admin

# Verify kubectl connectivity by listing nodes

kubectl get nodes

Sortie attendue :

Merged "ai-industrial-aks-eu-01-admin" as current context in /home/mark/.kube/config.

NAME STATUS ROLES AGE VERSION

aks-systempool-12345678-vmss000000 Ready agent 5m v1.29.4

aks-systempool-12345678-vmss000001 Ready agent 5m v1.29.4

Notez que les nœuds gpunodepool ne sont pas encore répertoriés. C'est parce que nous avons défini le node_count initial à 0. Ils seront provisionnés par l'autoscaler du cluster dès qu'une charge de travail demandera des ressources GPU.

3. Déploiement d'une charge de travail d'inférence IA sur des nœuds GPU

Maintenant, déployons un exemple de service d'inférence IA. Ce manifeste de déploiement Kubernetes indique au planificateur d'exécuter notre conteneur sur un nœud compatible GPU, connectant notre couche d'orchestration au matériel spécialisé.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: gpu-inference-app

labels:

app: gpu-inference

spec:

replicas: 1

selector:

matchLabels:

app: gpu-inference

template:

metadata:

labels:

app: gpu-inference

spec:

# L'affinité de nœud garantit que cette charge de travail s'exécute uniquement sur un nœud avec le GPU spécifié.

nodeSelector:

gpu: "nvidia-v100"

containers:

- name: inference-container

# Dans un scénario réel, vous utiliseriez votre image de modèle d'IA personnalisée.

# Cette image publique est une base avec les pilotes CUDA installés.

image: "mcr.microsoft.com/azureml/intelmpi2018.3-cuda10.0-cudnn7-ubuntu16.04:20191010.v1"

resources:

limits:

nvidia.com/gpu: 1 # Demande 1 GPU du nœud

ports:

- containerPort: 80

---

apiVersion: v1

kind: Service

metadata:

name: gpu-inference-service

spec:

selector:

app: gpu-inference

ports:

- protocol: TCP

port: 80

targetPort: 80

type: LoadBalancer # Expose le service avec une IP publique via Azure Load Balancer

Appliquez cette configuration à votre cluster :

# Apply the Kubernetes deployment and service

kubectl apply -f ai-inference-deployment.yaml

Sortie attendue :

deployment.apps/gpu-inference-app created

service/gpu-inference-service created

Cela déclenche l'autoscaler AKS. Il verra un pod qui nécessite un GPU, remarquera qu'il n'y a pas de nœuds disponibles et commencera à provisionner un nouveau nœud dans le gpunodepool.

4. Configuration de la mise en réseau globale en périphérie avec Azure Front Door

Pour rendre notre service d'IA accessible mondialement avec une faible latence, nous plaçons un équilibreur de charge global comme Azure Front Door devant lui. Bien que la configuration Terraform complète soit étendue, cet extrait conceptuel montre les ressources clés.

# networking.tf (conceptuel)

# Une politique de pare-feu d'application web (WAF) est un prérequis pour Front Door.

resource "azurerm_cdn_frontdoor_firewall_policy" "ai_waf_policy" {

name = "ai-app-waf-policy"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

enabled = true

mode = "Prevention"

}

# Le profil Front Door est la ressource de plus haut niveau.

resource "azurerm_cdn_frontdoor_profile" "ai_afd_profile" {

name = "ai-global-frontdoor-profile"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

}

# Un point de terminaison fournit le nom d'hôte public.

resource "azurerm_cdn_frontdoor_endpoint" "ai_afd_endpoint" {

name = "ai-endpoint-eu-prod-unique"

cdn_frontdoor_profile_id = azurerm_cdn_frontdoor_profile.ai_afd_profile.id

}

# Dans une configuration complète, vous définiriez également :

# 1. Un groupe d'origines pointant vers l'adresse IP publique du 'gpu-inference-service'.

# 2. Une route pour connecter le point de terminaison public au groupe d'origines.

# 3. Une politique de sécurité pour associer la politique WAF au point de terminaison.

Cette configuration tire parti du réseau edge mondial de Microsoft. Une requête utilisateur atteint le Point de Présence (PoP) le plus proche, qui l'achemine ensuite efficacement via le backbone privé de Microsoft vers notre service d'inférence dans westeurope, offrant une expérience rapide et sécurisée.

Dépannage et vérification

S'assurer que votre infrastructure d'IA industrielle est robuste nécessite une vérification approfondie. D'après mon expérience, la plupart des problèmes proviennent de mauvaises configurations au niveau du réseau, des permissions IAM ou de l'allocation des ressources.

Commandes de vérification

- Vérifier l'état du cluster AKS :

az aks show --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --query "provisioningState"

**Sortie attendue :** `"Succeeded"`

- Vérifier la présence des nœuds GPU (après le déploiement du pod) :

kubectl get nodes --selector=gpu=nvidia-v100

**Sortie attendue (après autoscaling) :**

NAME STATUS ROLES AGE VERSION

aks-gpunodepool-12345678-vmss000000 Ready agent 10m v1.29.4

- Vérifier l'état du pod d'inférence IA :

kubectl get pod -l app=gpu-inference

**Sortie attendue :** Le `STATUS` devrait être `Running`.

- Obtenir l'IP externe du service d'inférence :

kubectl get service gpu-inference-service

**Sortie attendue :** Le champ `EXTERNAL-IP` affichera une adresse IP publique après quelques minutes. C'est l'IP que vous configurerez dans votre origine Front Door.

Erreurs courantes et solutions

-

Erreur : Pod bloqué en état

Pendingavec l'avertissement de ressourcenvidia.com/gpu.- Symptôme :

kubectl describe pod <nom-du-pod>affiche un événement tel queFailedScheduling... 0/3 nœuds sont disponibles : 3 Insufficient nvidia.com/gpu. - Solution : Ceci est normal au début. L'autoscaler du cluster devrait provisionner un nouveau nœud GPU. Si cela prend plus de 5 à 10 minutes, vérifiez les diagnostics AKS pour les erreurs de l'autoscaler. Vérifiez également que votre

nodeSelectordans le YAML de déploiement correspond exactement auxnode_labelsde votre configuration Terraform.

- Symptôme :

-

Erreur : Le service

EXTERNAL-IPreste<pending>pendant une longue période.- Solution : Cela signifie généralement que l'équilibreur de charge Azure prend du temps pour provisionner une IP publique. Si cela persiste au-delà de 15 minutes, vérifiez les journaux d'activité du groupe de ressources pour toute défaillance de provisionnement. Cela pourrait également indiquer que vous avez atteint un quota d'adresses IP publiques dans votre abonnement.

-

Alerte FinOps : Coûts des GPU inactifs

- Symptôme : Votre facture cloud indique des coûts élevés pour les VM GPU, mais les métriques d'utilisation sont faibles.

- Solution : C'est un problème FinOps classique. Assurez-vous que votre autoscaler de cluster est correctement configuré non seulement pour augmenter la taille, mais aussi pour la réduire. Définissez

min_count = 0sur les pools de nœuds coûteux qui ne sont pas toujours nécessaires. Surveillez attentivement la planification des pods et l'utilisation des nœuds pour vous assurer que vous ne payez pas pour du matériel inactif et coûteux.

Conclusion et prochaines étapes

La troisième couche de l'IA – l'épine dorsale industrielle des centres de données et des services cloud – est là où le vrai travail se déroule. C'est l'infrastructure critique qui transforme des modèles puissants en services publics évolutifs, fiables et mondiaux. En tant qu'architecte, je souligne constamment que négliger cette fondation, c'est comme construire un gratte-ciel sur du sable. Le succès de l'IA à grande échelle dépend entièrement de l'infrastructure robuste et globale que nous déployons.

Adopter une mentalité de service public

La métaphore de « l'IA comme un service public » n'est pas seulement conceptuelle ; elle doit dicter nos choix architecturaux. Nous concevons pour la résilience, l'évolutivité et l'efficacité, un peu comme le ferait un opérateur de réseau électrique. Cela inclut tout, des conceptions de centres de données écoénergétiques à la mise à l'échelle automatisée des clusters GPU et à la mise en réseau géographiquement distribuée. Les implications financières sont également profondes, nécessitant une stratégie FinOps rigoureuse pour gérer les coûts opérationnels substantiels.

Points clés à retenir

- Les fondations physiques comptent : Le « cloud » de l'IA est une infrastructure physique massive nécessitant une planification minutieuse de l'alimentation électrique, du refroidissement et de la connectivité.

- L'orchestration est essentielle : Kubernetes géré (comme AKS avec des nœuds GPU) est crucial pour déployer et gérer efficacement les charges de travail d'IA.

- La mise en réseau globale est non négociable : Les réseaux edge et les équilibreurs de charge globaux (comme Azure Front Door) sont essentiels pour des services d'IA à faible latence et haute disponibilité.

- L'infrastructure en tant que code est obligatoire : Des outils comme Terraform sont vitaux pour des déploiements d'infrastructure reproductibles, cohérents et versionnés.

Ressources du dépôt

Le code complet et spécifique au projet pour une architecture aussi complète est généralement détenu dans des dépôts clients privés. Cependant, la documentation officielle et les exemples publics ci-dessous sont d'excellents points de départ pour chaque composant.

- Modèles de démarrage rapide Azure pour AKS : `https://github.com/Azure/azure-quickstart-templates/tree/master/quickstarts/microsoft.containerservice/aks

* **Exemples de fournisseur Terraform Azure :**

https://github.com/hashicorp/terraform-provider-azurerm/tree/main/examples

* **Exemples Azure ML avancés :**

https://github.com/Azure/azureml-examples

* **Documentation Kubernetes :**

https://kubernetes.io/docs/home/`