Requisitos previos

Cuando se escucha a las empresas hablar sobre sus ambiciones en IA, a menudo existe una profunda fascinación por los modelos y algoritmos, pero un punto ciego común respecto a la inmensa potencia industrial necesaria para ejecutar estos sistemas. El desafío no es solo construir software inteligente; es arquitectar las instalaciones físicas, la red robusta y la orquestación sofisticada necesarias para operar la IA a una escala comparable a la de un servicio público nacional. Estamos hablando de una red global de capacidad de cómputo especializada, no solo de una factura abstracta de un proveedor de la nube.

Este artículo desglosa esta crucial tercera capa de la IA —los centros de datos y los servicios en la nube— y demuestra cómo construir una infraestructura capaz de soportar la IA a escala industrial. Mi objetivo es desmitificar los componentes fundamentales y compartir las mejores prácticas de implementaciones en el mundo real, tratando la IA no como magia, sino como la potente utilidad en la que se está convirtiendo.

Para seguir los ejemplos concretos, necesitará el conjunto de herramientas estándar para implementaciones de Azure de grado de producción. Trabajar con las últimas versiones estables garantiza la compatibilidad y el acceso a características críticas.

- Azure CLI: Versión

2.58.0o posterior. Esta es mi herramienta preferida para toda interacción programática con Azure. Compruebe su versión conaz --version. - Terraform CLI: Versión

1.7.0o posterior. Para la infraestructura como código, Terraform es indispensable para crear entornos repetibles y versionados. Compruebe conterraform version. kubectlCLI: Versión1.29o posterior. Este es el estándar universal para gestionar clústeres de Kubernetes. Verifique conkubectl version --client.- Suscripción de Azure: Necesitará una suscripción activa con permisos para crear recursos, incluidos clústeres de Kubernetes, redes virtuales e instancias de Front Door. Todos mis ejemplos utilizarán regiones europeas como

westeuropeynortheurope.

Arquitectura: La red de servicios públicos para la inteligencia

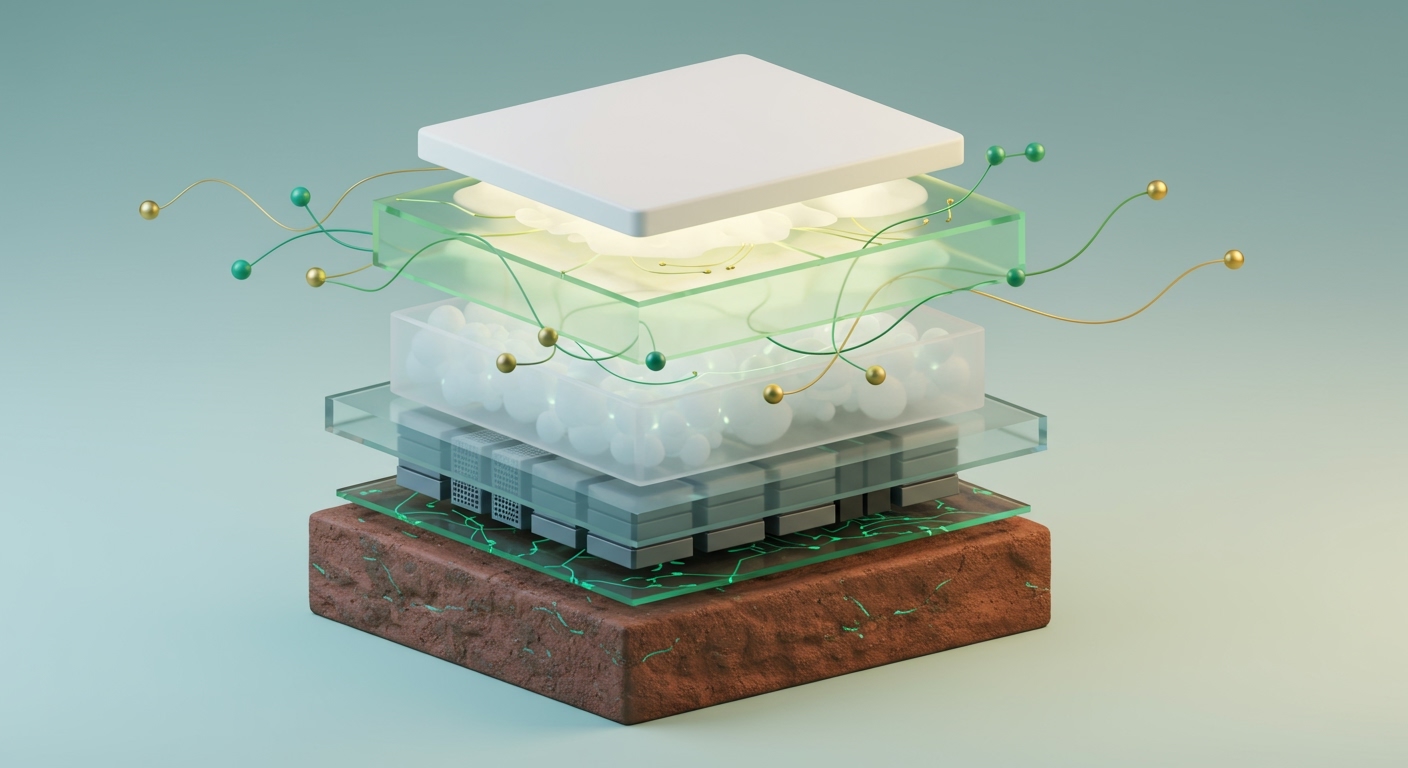

La capa industrial de la IA se comprende mejor tratando la capacidad de cómputo como un servicio público. Así como una central eléctrica genera electricidad que fluye a través de una red hacia hogares y fábricas, los centros de datos generan cómputo de IA que fluye a través de redes globales hacia las aplicaciones. Muchas organizaciones subestiman los desafíos físicos y logísticos. No se trata de poner en marcha unas pocas máquinas virtuales; se trata de optimizar la energía, la refrigeración, la interconectividad de la red y la seguridad a una escala masiva e implacable.

En el corazón de esta capa se encuentran los modernos centros de datos operados por proveedores de la nube como Microsoft Azure, Amazon o Google. Estas instalaciones albergan vastas matrices de hardware especializado —particularmente GPUs— interconectadas por redes de alto ancho de banda y baja latencia. Los servicios en la nube abstraen esta complejidad física, ofreciendo cómputo escalable (como Azure Kubernetes Service para cargas de trabajo de GPU), redes inteligentes (Azure Front Door para la gestión global del tráfico) y orquestación robusta (Azure Functions, Durable Functions y Service Bus).

La realidad física detrás de la nube

Cuando uno recorre centros de datos, la escala es asombrosa. El zumbido de miles de servidores, el inmenso volumen de aire movido por sistemas de refrigeración masivos y los interminables racks de fibra óptica meticulosamente cableados: esta es la base física de la IA. Por cada modelo que se ejecuta en la nube, hay un gasto correspondiente de electricidad y una huella física tangible. Esta realidad sustenta toda la tercera capa y tiene implicaciones significativas para FinOps (es decir, el dinero).

Este enfoque componible, donde construimos la IA utilizando servicios interconectados y especializados, es la clave. En lugar de sistemas monolíticos, aprovechamos las API estándar para la interoperabilidad, lo que es nuestra mejor defensa contra la dependencia del proveedor (vendor lock-in).

Componentes arquitectónicos clave

Para un sistema de IA a escala industrial, me centro en cuatro pilares principales:

-

Clústeres de cómputo de alto rendimiento: Aquí es donde se realiza el trabajo pesado del entrenamiento e inferencia de IA. La elección a menudo es un servicio de Kubernetes gestionado como Azure Kubernetes Service (AKS) ejecutándose en máquinas virtuales habilitadas para GPU (pronto escribiré sobre GPUs sin servidor). Proporciona la orquestación necesaria para desplegar, escalar y gestionar cargas de trabajo de IA en contenedores sin la sobrecarga de gestionar el plano de control.

-

Red global y entrega en el borde: Las aplicaciones de IA deben ser rápidas y receptivas, independientemente de la ubicación del usuario. Utilice servicios como Azure Front Door o la red global de Cloudflare como punto de entrada inteligente. Gestionan la terminación TLS, el almacenamiento en caché, la protección contra DDoS y el enrutamiento eficiente del tráfico al backend saludable más cercano. Esto no es negociable para minimizar la latencia.

-

Almacenamiento y gestión de datos: Las cargas de trabajo de IA son ávidas de datos. Esto requiere una estrategia de almacenamiento multifacética: almacenamiento de objetos (Azure Blob Storage) para grandes conjuntos de datos y artefactos de modelos, bases de datos vectoriales especializadas para patrones de Generación Aumentada por Recuperación (RAG), y bases de datos tradicionales para el estado de la aplicación. Las sólidas tuberías de datos (data pipelines) son el sistema circulatorio que las conecta a todas.

-

Orquestación y automatización: Más allá del cómputo básico, orquestar flujos de trabajo complejos de IA es fundamental. Esto implica el uso de componentes sin servidor como Azure Functions o funciones de Google Cloud Run para tareas sin estado (por ejemplo, el preprocesamiento de una solicitud API) y Durable Functions para flujos de trabajo con estado y de larga duración. Los servicios de mensajería como Azure Service Bus proporcionan el pegamento duradero y asíncrono entre estos microservicios.

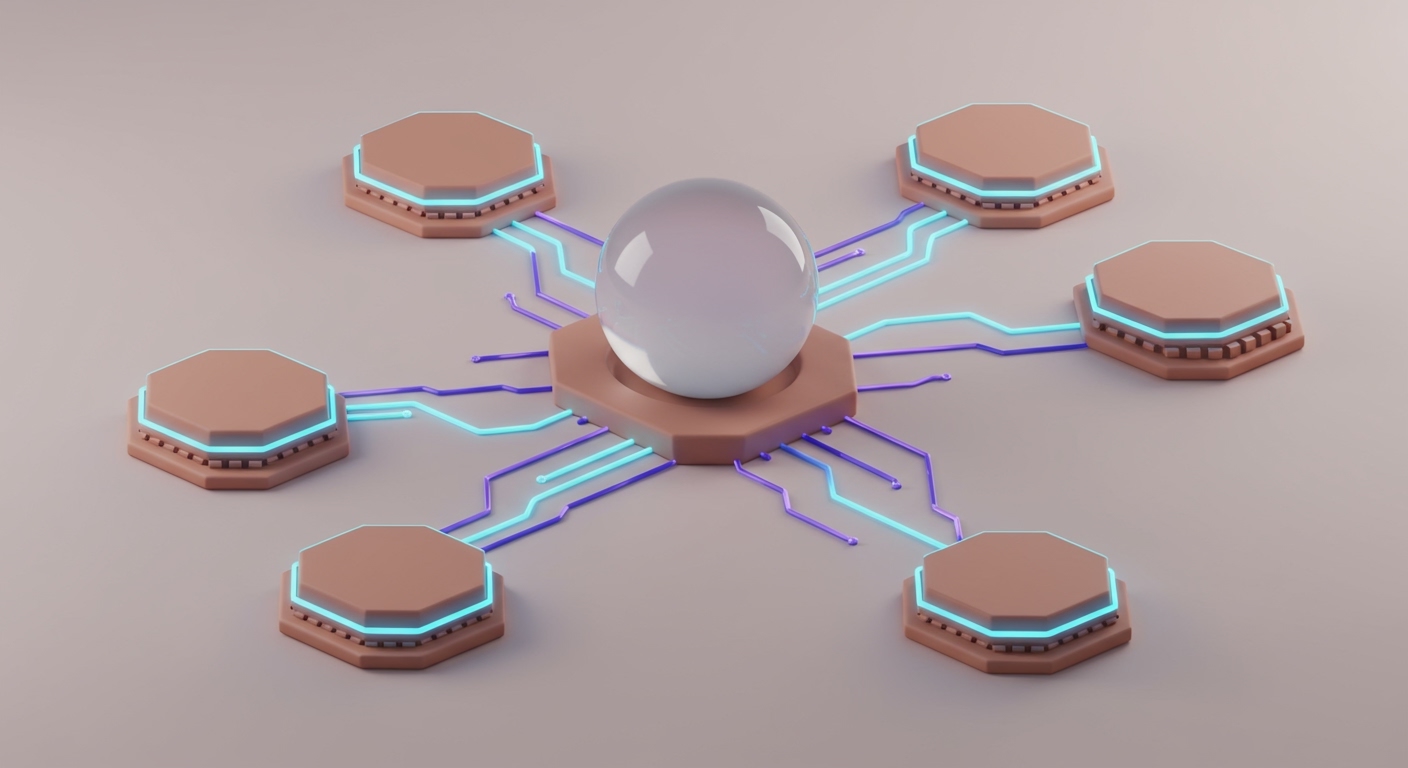

Aquí tiene un diagrama que muestra cómo estos elementos interactúan para formar una capa cohesiva de IA industrial.

Gobernanza y seguridad de modelos

Para cualquier carga de trabajo de producción, la gobernanza y la seguridad de los modelos no son opcionales. Esta es una lista de verificación básica para garantizar la integridad, la auditabilidad y el uso responsable de los modelos de IA a escala:

- Control de versiones: Los modelos son artefactos de software. Deben ser versionados en un registro dedicado, como el de Azure Machine Learning, para permitir reversiones e historiales de implementación auditables.

- Control de acceso estricto: Utilice políticas de IAM de grano fino para controlar quién puede acceder, desplegar e invocar modelos. El principio del menor privilegio es primordial.

- Registro de auditoría exhaustivo: Registre cada invocación de modelo, incluidos los datos de entrada (o su hash), la salida y la identidad del llamador. Esto es esencial para la trazabilidad y el cumplimiento.

- Puntos finales seguros: Todos los modelos deben desplegarse detrás de una puerta de enlace API segura que imponga autenticación, autorización y limitación de velocidad.

- Cifrado de datos: Todos los datos, ya sea en tránsito por la red o en reposo en el almacenamiento, deben cifrarse utilizando claves fuertes y gestionadas.

Con ese modelo arquitectónico en mente, sentemos la primera parte de nuestra base: el clúster de cómputo.

Ejemplo de código: Terraform para un clúster AKS habilitado para GPU

Esta configuración de Terraform provisiona un clúster de Azure Kubernetes Service (AKS) con un pool de nodos dedicado para máquinas habilitadas para GPU en westeurope. Este es el bloque de cómputo fundamental para nuestra implementación de IA industrial.

# main.tf

# Configure the Azure provider to a European region

provider "azurerm" {

features {}

# Using 'westeurope' as our primary region for compute resources.

# For HA systems, we'd deploy to multiple European regions.

}

resource "azurerm_resource_group" "ai_infra_rg" {

name = "ai-compute-rg-production-eu"

location = "westeurope"

}

resource "azurerm_kubernetes_cluster" "ai_aks_cluster" {

name = "ai-industrial-aks-eu-01"

location = azurerm_resource_group.ai_infra_rg.location

resource_group_name = azurerm_resource_group.ai_infra_rg.name

dns_prefix = "ai-aks-eu"

kubernetes_version = "1.29.4" # Align with current stable AKS versions

default_node_pool {

name = "systempool"

node_count = 2

vm_size = "Standard_DS2_v2"

os_disk_size_gb = 30

auto_scaling_enabled = true

min_count = 1

max_count = 3

}

identity {

type = "SystemAssigned"

}

network_profile {

network_plugin = "azure"

load_balancer_sku = "standard"

service_cidr = "10.0.0.0/16"

dns_service_ip = "10.0.0.10"

docker_bridge_cidr = "172.17.0.1/16"

}

tags = {

"project" = "AIIndustrialScale"

"environment" = "Production"

}

}

# Dedicated node pool for GPU workloads, critical for industrial AI scale.

# This uses 'Standard_NC6s_v3' with NVIDIA V100 GPUs.

resource "azurerm_kubernetes_cluster_node_pool" "ai_gpu_node_pool" {

name = "gpunodepool"

kubernetes_cluster_id = azurerm_kubernetes_cluster.ai_aks_cluster.id

vm_size = "Standard_NC6s_v3"

node_count = 0 # Start with 0 and scale as needed to manage costs

os_disk_size_gb = 60

auto_scaling_enabled = true

min_count = 0

max_count = 5 # Scale up to 5 GPU nodes based on demand

node_labels = {

"agentpool" = "gpunodepool"

"gpu" = "nvidia-v100"

}

tags = {

"environment" = "production"

"ai_layer" = "industrial"

}

}

output "kubernetes_cluster_name" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.name

description = "The name of the Kubernetes cluster."

}

output "kubernetes_cluster_id" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.id

description = "The ID of the Kubernetes cluster."

}

Guía de implementación

La construcción de la capa de IA industrial es un proceso metódico. Divídalo en asegurar el cómputo central, establecer el alcance de la red global y luego desplegar las cargas de trabajo de IA. Cada paso se centra en crear una infraestructura robusta y escalable adecuada para operaciones a escala de utilidad pública.

1. Aprovisionamiento del clúster AKS habilitado para GPU

Primero, desplegaremos el clúster de cómputo fundamental utilizando la configuración de Terraform anterior.

# Initialize Terraform in your project directory

terraform init

# Review the planned changes before applying

terraform plan -out=aks_gpu_plan.tfplan

# Apply the Terraform configuration to provision resources

terraform apply "aks_gpu_plan.tfplan"

Después de unos minutos, Terraform finalizará y verá los resultados que confirman la creación del clúster.

Salida esperada:

Apply complete! Resources: 3 added, 0 changed, 0 destroyed.

Outputs:

kubernetes_cluster_id = "/subscriptions/<your-subscription-id>/resourceGroups/ai-compute-rg-production-eu/providers/Microsoft.ContainerService/managedClusters/ai-industrial-aks-eu-01"

kubernetes_cluster_name = "ai-industrial-aks-eu-01"

Esto confirma que su clúster AKS, con su pool de nodos GPU listo para escalar, ha sido desplegado exitosamente en westeurope.

2. Configurar el acceso a `kubectl

Una vez que el clúster esté en funcionamiento, debe configurar su cliente

kubectl` local para interactuar con él. Azure CLI simplifica esto al recuperar las credenciales del clúster.

# Get AKS cluster credentials (using admin for simplicity, use user auth in production)

az aks get-credentials --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --overwrite-existing --admin

# Verify kubectl connectivity by listing nodes

kubectl get nodes

Salida esperada:

Merged "ai-industrial-aks-eu-01-admin" as current context in /home/mark/.kube/config.

NAME STATUS ROLES AGE VERSION

aks-systempool-12345678-vmss000000 Ready agent 5m v1.29.4

aks-systempool-12345678-vmss000001 Ready agent 5m v1.29.4

Observe que los nodos gpunodepool aún no están listados. Esto se debe a que establecimos el node_count inicial en 0. Serán provisionados por el autoescalador del clúster una vez que una carga de trabajo solicite recursos de GPU.

3. Despliegue de una carga de trabajo de inferencia de IA en nodos GPU

Ahora, despleguemos un servicio de inferencia de IA de ejemplo. Este manifiesto de despliegue de Kubernetes instruye al planificador para que ejecute nuestro contenedor en un nodo habilitado para GPU, conectando nuestra capa de orquestación con el hardware especializado.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: gpu-inference-app

labels:

app: gpu-inference

spec:

replicas: 1

selector:

matchLabels:

app: gpu-inference

template:

metadata:

labels:

app: gpu-inference

spec:

# Node affinity ensures this workload runs only on a node with the specified GPU.

nodeSelector:

gpu: "nvidia-v100"

containers:

- name: inference-container

# In a real scenario, you'd use your custom AI model image.

# This public image is a base with CUDA drivers installed.

image: "mcr.microsoft.com/azureml/intelmpi2018.3-cuda10.0-cudnn7-ubuntu16.04:20191010.v1"

resources:

limits:

nvidia.com/gpu: 1 # Request 1 GPU from the node

ports:

- containerPort: 80

---

apiVersion: v1

kind: Service

metadata:

name: gpu-inference-service

spec:

selector:

app: gpu-inference

ports:

- protocol: TCP

port: 80

targetPort: 80

type: LoadBalancer # Expose the service with a public IP via Azure Load Balancer

Aplique esta configuración a su clúster:

# Apply the Kubernetes deployment and service

kubectl apply -f ai-inference-deployment.yaml

Salida esperada:

deployment.apps/gpu-inference-app created

service/gpu-inference-service created

Esto activa el autoescalador de AKS. Verá un pod que requiere una GPU, notará que no hay nodos disponibles y comenzará a provisionar un nuevo nodo en el gpunodepool.

4. Configuración de la red global de borde con Azure Front Door

Para hacer que nuestro servicio de IA sea accesible globalmente con baja latencia, colocamos un balanceador de carga global como Azure Front Door frente a él. Si bien la configuración completa de Terraform es extensa, este fragmento conceptual muestra los recursos clave.

# networking.tf (conceptual)

# A Web Application Firewall (WAF) policy is a prerequisite for Front Door.

resource "azurerm_cdn_frontdoor_firewall_policy" "ai_waf_policy" {

name = "ai-app-waf-policy"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

enabled = true

mode = "Prevention"

}

# The Front Door profile is the top-level resource.

resource "azurerm_cdn_frontdoor_profile" "ai_afd_profile" {

name = "ai-global-frontdoor-profile"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

}

# An endpoint provides the public-facing hostname.

resource "azurerm_cdn_frontdoor_endpoint" "ai_afd_endpoint" {

name = "ai-endpoint-eu-prod-unique"

cdn_frontdoor_profile_id = azurerm_cdn_frontdoor_profile.ai_afd_profile.id

}

# In a complete configuration, you would also define:

# 1. An Origin Group pointing to the public IP of the 'gpu-inference-service'.

# 2. A Route to connect the public endpoint to the origin group.

# 3. A Security Policy to associate the WAF policy with the endpoint.

Esta configuración aprovecha la red global de borde de Microsoft. Una solicitud de usuario llega al Punto de Presencia (PoP) más cercano, que luego la enruta eficientemente a través de la red troncal privada de Microsoft a nuestro servicio de inferencia en westeurope, proporcionando una experiencia rápida y segura.

Resolución de problemas y verificación

Asegurar que su infraestructura de IA industrial sea robusta requiere una verificación exhaustiva. En mi experiencia, la mayoría de los problemas provienen de configuraciones erróneas en redes, permisos de IAM o asignación de recursos.

Comandos de verificación

- Comprobar el estado del clúster AKS:

az aks show --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --query "provisioningState"

**Salida esperada:** `"Succeeded"`

- Verificar la presencia de nodos GPU (después del despliegue del pod):

kubectl get nodes --selector=gpu=nvidia-v100

**Salida esperada (después del autoescalado):**

NAME STATUS ROLES AGE VERSION

aks-gpunodepool-12345678-vmss000000 Ready agent 10m v1.29.4

- Comprobar el estado del pod de inferencia de IA:

kubectl get pod -l app=gpu-inference

**Salida esperada:** `STATUS` debería ser `Running`.

- Obtener la IP externa del servicio de inferencia:

kubectl get service gpu-inference-service

**Salida esperada:** El campo `EXTERNAL-IP` mostrará una dirección IP pública después de unos minutos. Esta es la IP que se configura en su origen de Front Door.

Errores comunes y soluciones

-

Error: Pod atascado en estado

Pendingcon advertencia de recursonvidia.com/gpu.- Síntoma:

kubectl describe pod <pod-name>muestra un evento comoFailedScheduling... 0/3 nodos disponibles: 3 Insufficient nvidia.com/gpu. - Solución: Esto es normal inicialmente. El autoescalador del clúster debería estar aprovisionando un nuevo nodo GPU. Si tarda más de 5-10 minutos, verifique los diagnósticos de AKS en busca de errores del autoescalador. Además, verifique que su

nodeSelectoren el YAML de despliegue coincida exactamente con lasnode_labelsen su configuración de Terraform.

- Síntoma:

-

Error: El

EXTERNAL-IPdel servicio permanece<pending>durante mucho tiempo.- Solución: Esto generalmente significa que el equilibrador de carga de Azure está tardando en aprovisionar una IP pública. Si persiste más allá de 15 minutos, revise los registros de actividad del grupo de recursos en busca de fallos de aprovisionamiento. También podría indicar que ha alcanzado una cuota de direcciones IP públicas en su suscripción.

-

Alerta de FinOps: Costos de GPU ociosas

- Síntoma: Su factura de la nube muestra altos costos por máquinas virtuales GPU, pero las métricas de utilización son bajas.

- Solución: Este es un problema clásico de FinOps. Asegúrese de que su autoescalador de clúster esté configurado correctamente no solo para escalar hacia arriba, sino también para escalar hacia abajo. Establezca

min_count = 0en los pools de nodos costosos que no siempre son necesarios. Monitoree de cerca la programación de pods y la utilización de nodos para asegurarse de que no está pagando por hardware ocioso y de alto costo.

Conclusión y próximos pasos

La tercera capa de la IA —la columna vertebral industrial de los centros de datos y servicios en la nube— es donde ocurre el verdadero trabajo. Es la infraestructura crítica que transforma modelos potentes en utilidades escalables, fiables y globales. Como arquitecto, siempre hago hincapié en que descuidar esta base es como construir un rascacielos sobre arena. El éxito de la IA a escala depende enteramente de la infraestructura robusta y global que despleguemos.

Adoptar una mentalidad de servicio público

La metáfora de 'la IA como servicio público' no es solo conceptual; debe dictar nuestras elecciones arquitectónicas. Diseñamos para la resiliencia, la escalabilidad y la eficiencia, de manera muy similar a como lo haría un operador de red eléctrica. Esto incluye todo, desde diseños de centros de datos energéticamente eficientes hasta el escalado automatizado de clústeres de GPU y redes distribuidas geográficamente. Las implicaciones financieras también son profundas, requiriendo una estrategia rigurosa de FinOps para gestionar los sustanciales costos operativos.

Puntos clave

- Las bases físicas importan: La "nube" de IA es una infraestructura física masiva que requiere una planificación cuidadosa para la energía, la refrigeración y la conectividad.

- La orquestación es clave: Kubernetes gestionado (como AKS con nodos GPU) es crucial para desplegar y gestionar cargas de trabajo de IA de manera eficiente.

- La red global no es negociable: Las redes de borde y los balanceadores de carga globales (como Azure Front Door) son esenciales para servicios de IA de baja latencia y alta disponibilidad.

- La infraestructura como código es obligatoria: Herramientas como Terraform son vitales para implementaciones de infraestructura repetibles, consistentes y con control de versiones.

Recursos del repositorio

El código completo y específico del proyecto para una arquitectura tan exhaustiva suele guardarse en repositorios de clientes privados. Sin embargo, la documentación oficial y los ejemplos públicos que se encuentran a continuación son excelentes puntos de partida para cada componente.

- Plantillas de inicio rápido de Azure para AKS: `https://github.com/Azure/azure-quickstart-templates/tree/master/quickstarts/microsoft.containerservice/aks

* **Ejemplos del proveedor de Azure de Terraform:**

https://github.com/hashicorp/terraform-provider-azurerm/tree/main/examples

* **Ejemplos avanzados de Azure ML:**

https://github.com/Azure/azureml-examples

* **Documentación de Kubernetes:**

https://kubernetes.io/docs/home/`