Requisitos previos

La quinta capa de IA: Donde los modelos se encuentran con la realidad y el ROI

En las iniciativas de IA, el cuello de botella rara vez es el algoritmo en sí. Hay innumerables organizaciones que invierten mucho en las capas fundamentales de la IA: adquiriendo GPUs de última generación, construyendo enormes lagos de datos y entrenando modelos sofisticados. Sin embargo, surge una trampa común y costosa cuando llega el momento de obtener el retorno real de esa inversión: la capa de aplicación. Esta es la "última milla" de la IA, donde el poder teórico de un modelo debe integrarse sin problemas en los flujos de trabajo empresariales existentes, los sistemas seguros y las experiencias de usuario.

Modelos brillantes permanecen inactivos porque no pudieron integrarse de forma segura con bases de datos heredadas como SAP u Oracle EHRs, no cumplieron con los requisitos de conformidad, o simplemente no pudieron escalar para manejar la demanda de los usuarios. El desafío no es solo hacer que un modelo de IA funcione; se trata de hacerlo funcionar en el mundo real para ofrecer un beneficio económico medible.

La capa de aplicación es la "última milla" de la inteligencia artificial, y es la única capa que genera un retorno de la inversión (ROI). Si una aplicación de IA no puede integrarse de forma segura con los proveedores de identidad empresariales existentes (IAM), las bases de datos heredadas (SAP, Oracle, EHRs hospitalarios) y los flujos de trabajo de los usuarios, el gasto masivo de capital en GPUs y entrenamiento de modelos se desperdicia por completo.

Esta guía presenta un enfoque probado en campo para diseñar y desplegar aplicaciones de IA que salvan esta brecha. Recorreremos las consideraciones críticas para construir esta "quinta capa de IA" y convertir los modelos en valor.

Antes de comenzar a desplegar aplicaciones de IA, es fundamental contar con el conjunto de herramientas adecuado y los conocimientos fundamentales. Siempre aconsejo a mis clientes que estandaricen una plataforma moderna de orquestación de contenedores y que tengan listas sus herramientas principales en la nube. Para los ejemplos que siguen, asumiré que usted tiene un conocimiento práctico de:

- Contenerización:

Docker Engine(versión24.0o posterior). - Kubernetes: Un clúster en funcionamiento y un cliente

kubectlconfigurado (versión1.28o posterior). - CLI del proveedor de la nube: La CLI

gcloud,awsoaz, según su nube de elección. - Python 3.9+: Para desarrollar la lógica de la aplicación y las interacciones de la API.

- Fundamentos de redes: Una comprensión sólida del balanceo de carga, controladores de entrada (ingress controllers) y mallas de servicios (service meshes).

Arquitectura: El plano para la IA en el mundo real

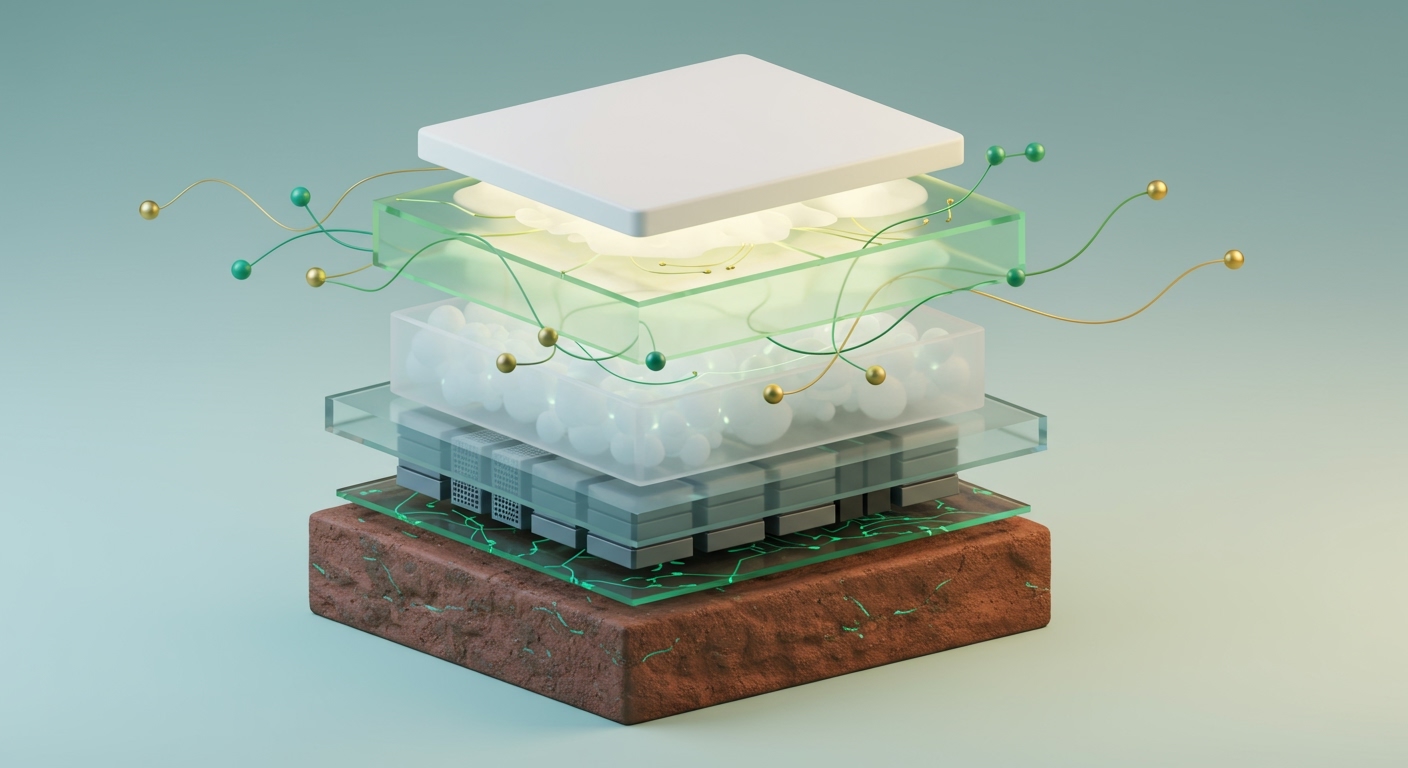

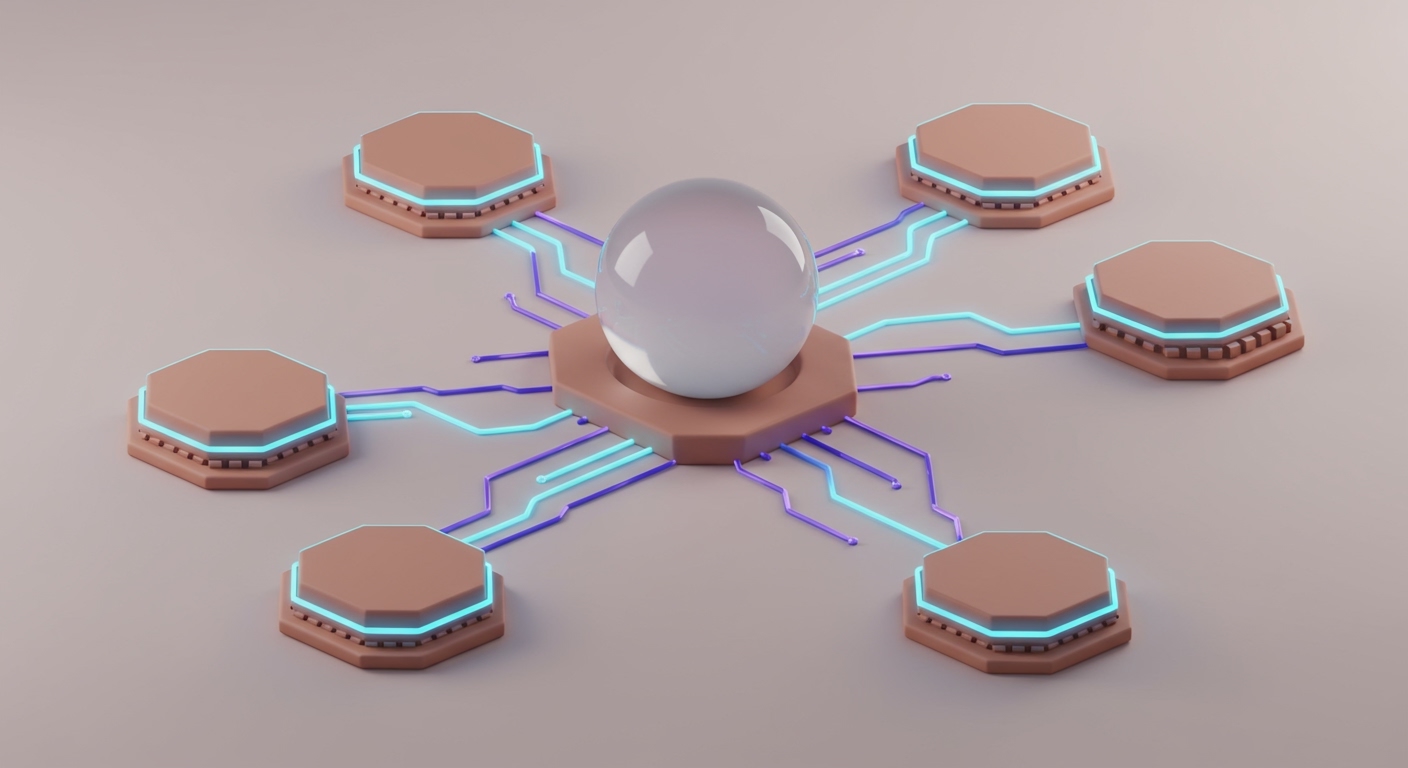

La "quinta capa de IA" no es una tecnología única, sino un patrón arquitectónico para ofrecer capacidades de IA como aplicaciones robustas, escalables y seguras. Cuando diseño estos sistemas en GCP, AWS o Azure, mi primer principio es desacoplar el servicio central de inferencia de IA del resto de la pila de la aplicación, encapsulándolo como un microservicio dedicado.

Aquí hay un desglose típico de la arquitectura para sistemas de IA en producción:

- Aplicación cliente: El componente orientado al usuario, ya sea una aplicación web, una aplicación móvil o una herramienta empresarial interna. Inicia las solicitudes al servicio de IA.

- API Gateway: Todas las solicitudes externas deben pasar por un API Gateway como Apigee, Amazon API Gateway o Azure API Management. Esta es mi capa de seguridad y gestión no negociable para manejar la autenticación, autorización, limitación de velocidad (rate limiting) y enrutamiento de solicitudes.

- Backend de la aplicación: Una capa de microservicio estándar que orquesta las llamadas, agrega datos de varias fuentes y contiene la lógica de negocio central. Traduce las solicitudes de alto nivel del cliente en llamadas específicas al servicio de IA.

- Servicio de inferencia de IA: El corazón de la capacidad de IA. Despliéguelo como un servicio en contenedores, alojando el modelo entrenado y exponiendo un punto final de API simple para la inferencia. Este servicio debe ser de alta disponibilidad y escalable, a menudo aprovechando nodos acelerados por GPU.

- Almacenes de datos: Dependiendo del caso de uso, esto incluye bases de datos operacionales para el estado de la aplicación, bases de datos vectoriales para incrustaciones (embeddings) y almacenes de datos (data warehouses) para análisis y retroalimentación.

- Bus/Cola de eventos: Para tareas asíncronas y bucles de retroalimentación, una plataforma de transmisión de eventos como Kafka, GCP Pub/Sub o AWS Kinesis es esencial. Desacopla los procesos de larga duración del ciclo de solicitud-respuesta del usuario.

Gobernanza y seguridad del modelo

La gobernanza es el aspecto más frecuentemente pasado por alto en el despliegue de modelos. Para las cargas de trabajo de producción, la confianza y el cumplimiento son innegociables. Aquí está mi lista de verificación:

- Firma de modelos: Utilice herramientas como

SigstoreyCosignpara firmar criptográficamente los artefactos del modelo y sus imágenes de contenedor. Esto evita la manipulación y proporciona una cadena de custodia verificable desde el pipeline de MLOps hasta la producción. - Escaneo de vulnerabilidades: Escanee regularmente todas las dependencias del modelo y las imágenes de contenedor en busca de vulnerabilidades conocidas. Utilice herramientas como

Trivyo los escáneres integrados en registros en la nube como Google Container Registry (GCR) o Amazon Elastic Container Registry (ECR). - Auditabilidad y linaje: Implemente un registro robusto de todas las entradas, salidas, predicciones e información de versión del modelo. Debe mantener un linaje claro desde los datos de entrenamiento hasta el modelo desplegado para el cumplimiento normativo (p. ej., GDPR, HIPAA) y una depuración efectiva.

- Control de acceso: Aplique políticas de IAM estrictas y de menor privilegio. El servicio de inferencia solo debe tener los permisos que absolutamente necesita para acceder a los modelos y los datos.

Esta base arquitectónica es lo que separa un proyecto científico de un sistema de grado de producción. Ahora, hagámoslo realidad.

Guía de implementación

Desplegar una aplicación de IA en producción es un proceso sistemático. Aquí está mi experiencia en la contenerización de un modelo de IA, su despliegue en Kubernetes y su exposición de forma segura.

Paso 1: Contenerice su modelo de IA

Primero, empaquetamos el modelo de IA entrenado y su código de inferencia en una imagen de Docker. Esto garantiza la portabilidad y una ejecución consistente. Recomiendo comenzar con una imagen base mínima como python:3.9-slim-buster para mantener la imagen pequeña y segura.

# Dockerfile for AI Inference Service

# Use a lightweight base image for efficiency

FROM python:3.9-slim-buster

WORKDIR /app

# Install dependencies

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

# Copy your model and inference script

COPY model.pkl ./models/model.pkl

COPY inference_app.py .

# Expose the port your application listens on

EXPOSE 8080

# Command to run your application using Gunicorn or equivalent WSGI server

# This assumes your inference_app.py contains a Flask/FastAPI app instance

CMD ["gunicorn", "--bind", "0.0.0.0:8080", "inference_app:app"]

Después de construir la imagen, la subirá a su registro de contenedores (p. ej., GCR, ECR, Docker Hub).

# Build the Docker image

docker build -t your-org/your-ai-model-image:v1.0 .

# Expected Output:

# Successfully built <image-id>

# Successfully tagged your-org/your-ai-model-image:v1.0

# Authenticate Docker to your registry (example for GCP)

gcloud auth configure-docker

# Tag and push the image to a specific registry path

docker tag your-org/your-ai-model-image:v1.0 gcr.io/your-gcp-project/your-ai-model-image:v1.0

docker push gcr.io/your-gcp-project/your-ai-model-image:v1.0

Paso 2: Despliegue el servicio de inferencia en Kubernetes

A continuación, definiremos nuestro despliegue en Kubernetes. Este archivo YAML le indica a Kubernetes cómo ejecutar nuestro contenedor, incluyendo cuántas réplicas mantener para alta disponibilidad y qué recursos asignar. La ruta de la imagen debe coincidir con la que acaba de subir a su registro.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: ai-inference-service

labels:

app: ai-inference

spec:

replicas: 2 # Start with 2 replicas for high availability

selector:

matchLabels:

app: ai-inference

template:

metadata:

labels:

app: ai-inference

spec:

containers:

- name: inference-container

image: gcr.io/your-gcp-project/your-ai-model-image:v1.0 # The image you pushed

ports:

- containerPort: 8080 # The port your AI model listens on

resources:

requests:

cpu: "500m"

memory: "1Gi"

# nvidia.com/gpu: "1" # Correct key for NVIDIA GPUs

limits:

cpu: "1"

memory: "2Gi"

# nvidia.com/gpu: "1" # Correct key for NVIDIA GPUs

env:

- name: MODEL_PATH

value: "/app/models/model.pkl" # Path to your model within the container

livenessProbe:

httpGet:

path: /healthz

port: 8080

initialDelaySeconds: 10

periodSeconds: 5

readinessProbe:

httpGet:

path: /ready

port: 8080

initialDelaySeconds: 15

periodSeconds: 10

Aplique esta configuración a su clúster:

# Apply the deployment configuration

kubectl apply -f ai-inference-deployment.yaml

Expected Output:

deployment.apps/ai-inference-service created

Paso 3: Exponga el servicio a través de Kubernetes Service e Ingress

Nuestros pods están en funcionamiento, pero no son accesibles desde fuera del clúster. Necesitamos un Service para proporcionar un punto final interno estable y un Ingress para gestionar el tráfico externo, manejar la terminación SSL y realizar el enrutamiento basado en URL.

# ai-inference-service.yaml

apiVersion: v1

kind: Service

metadata:

name: ai-inference-service-internal

labels:

app: ai-inference

spec:

selector:

app: ai-inference

ports:

- protocol: TCP

port: 80 # Service port

targetPort: 8080 # Container port

type: ClusterIP # Internal service

---

# ai-inference-ingress.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: ai-inference-ingress

annotations:

# Example for NGINX Ingress Controller. Adjust for GCP/AWS/Azure specific ingresses.

nginx.ingress.kubernetes.io/rewrite-target: /

cert-manager.io/cluster-issuer: "letsencrypt-prod" # If using cert-manager for SSL

spec:

tls:

- hosts:

- ai.your-domain.com

secretName: ai-inference-tls # Secret to store SSL certificate

rules:

- host: ai.your-domain.com

http:

paths:

- path: /predict

pathType: Prefix

backend:

service:

name: ai-inference-service-internal

port:

number: 80

Aplique estos manifiestos para crear los recursos de red:

# Apply the service and ingress configurations

kubectl apply -f ai-inference-service.yaml

kubectl apply -f ai-inference-ingress.yaml

Expected Output:

service/ai-inference-service-internal created

ingress.networking.k8s.io/ai-inference-ingress created

Perspectiva del arquitecto de la nube — Servidor gestionado vs. Kubernetes puro: Para manejar el enrutamiento de tráfico avanzado (como pruebas A/B o lanzamientos Canary) y los ahorros de GPU con escalado a cero, implemento frameworks de servicio dedicados como KServe o utilizo puntos finales gestionados como GCP Vertex AI y AWS SageMaker.

Paso 4: Implemente un bucle de retroalimentación basado en eventos

Para mejorar continuamente un modelo, es fundamental capturar la retroalimentación del usuario o los datos de rendimiento del mundo real. Este proceso debe desacoplarse del flujo principal de la aplicación. Una arquitectura basada en eventos es el patrón estándar a utilizar aquí.

Imagine un fragmento de código JavaScript simple en su frontend que permite a un usuario calificar la calidad de una predicción:

// Frontend JavaScript snippet (e.g., in a React/Angular app)

async function submitFeedback(predictionId, userId, rating, details) {

const feedbackData = {

prediction_id: predictionId,

user_id: userId,

rating: rating, // e.g., 1 to 5 stars

details: details,

timestamp: new Date().toISOString()

};

try {

const response = await fetch('https://api.your-domain.com/feedback', {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer ' + getAuthToken() // Securely handle authentication

},

body: JSON.stringify(feedbackData)

});

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

console.log('Feedback submitted successfully!');

} catch (error) {

console.error('Error submitting feedback:', error);

}

}

// Example usage:

// submitFeedback('pred-123', 'user-abc', 5, 'Very accurate!');

Perspectiva del arquitecto de la nube — El bucle de retroalimentación basado en eventos: El código del frontend captura la retroalimentación, pero el verdadero desafío arquitectónico es enrutar esos datos de vuelta a la capa del modelo sin crear un monolito. En un sistema empresarial, esta carga útil de retroalimentación llega a un punto final del API Gateway, que valida la solicitud y publica el evento en una plataforma de streaming como Kafka o GCP Pub/Sub. Esto desacopla completamente la aplicación orientada al usuario del pipeline de MLOps. Los equipos de ingeniería de datos pueden entonces consumir, sanear y agregar asincrónicamente esta retroalimentación, disparando pipelines automatizados de reentrenamiento de modelos cuando el rendimiento se desvía.

Resolución de problemas y verificación

Una vez desplegado, debe verificar que todo funciona como se espera. Utilizo un enfoque metódico, comenzando desde la capa de infraestructura y ascendiendo hasta la aplicación.

Comandos de verificación

- Verificar el estado del pod: Asegúrese de que los pods de su servicio de inferencia estén saludables y en ejecución.

kubectl get pods -l app=ai-inference

# Expected output:

# NAME READY STATUS RESTARTS AGE

# ai-inference-service-xxxx-yyyy 1/1 Running 0 5m

# ai-inference-service-zzzz-wwww 1/1 Running 0 5m

- Verificar el servicio y el Ingress: Verifique que su red esté configurada correctamente y que el Ingress tenga una dirección IP externa.

kubectl get service ai-inference-service-internal

kubectl get ingress ai-inference-ingress

# Expected output for ingress (note the ADDRESS column):

# NAME CLASS HOSTS ADDRESS PORTS AGE

# ai-inference-ingress nginx ai.your-domain.com EXTERNAL_IP 80, 443 5m

- Probar el punto final de la API: Envíe una solicitud de prueba al punto final público de su servicio.

# Replace ai.your-domain.com with your actual ingress host

# and provide a sample payload expected by your model

curl -X POST -H "Content-Type: application/json" \

-d '{"features": [1.2, 3.4, 5.6]}' \

https://ai.your-domain.com/predict

# Expected output:

# {"prediction": "class_A", "confidence": 0.95}

Errores comunes y soluciones

-

Error:

ImagePullBackOff- Síntoma: Los pods no se inician con este estado.

- Causa: Kubernetes no puede extraer su imagen de Docker. Esto suele deberse a un error tipográfico en el nombre/etiqueta de la imagen en su

deployment.yaml, a que la imagen no existe en el registro, o a que el clúster carece de permisos para acceder a un registro privado. - Solución: Vuelva a verificar la ruta

image:en su YAML. Asegúrese de que la imagen y la etiqueta existan. Si el registro es privado, confirme que unimagePullSecretestá configurado correctamente o que el rol IAM del nodo tiene permisos.

-

Error:

CrashLoopBackOff- Síntoma: Los pods se inician, luego fallan inmediatamente y se reinician en un bucle.

- Causa: Su aplicación dentro del contenedor está fallando. Las razones comunes incluyen una variable de entorno faltante, una ruta de archivo incorrecta al modelo, un error en el código de inicio o una dependencia faltante.

- Solución: Inspeccione los logs del contenedor. Esta es su herramienta de diagnóstico más importante.

kubectl logs ai-inference-service-xxxx-yyyy # Replace with your actual pod name

# Look for Python tracebacks or other specific error messages.

- Error:

502 Bad Gatewaydesde Ingress- Síntoma: Las solicitudes

curla su URL pública fallan con un error 502. - Causa: El controlador Ingress no puede comunicarse con su servicio. Esto es casi siempre una falta de coincidencia entre las etiquetas o los puertos.

- Solución: Verifique que el

service.nameyservice.port.numberen su manifiestoIngresscoincidan conmetadata.nameyspec.ports.porten su manifiestoService. Luego, verifique quetargetPorten elServicecoincida concontainerPorten suDeployment.

- Síntoma: Las solicitudes

La realidad FinOps de la infraestructura de IA

La orquestación no se trata solo del rendimiento; se trata del control de costos. Un fallo común y costoso que veo es el gasto en GPUs inactivas. Dejar un clúster de GPUs de alta densidad inactivo, incluso durante unas pocas horas, puede quemar miles de dólares. La automatización implacable es la única solución.

- Automatizar el escalado a cero: Para entornos de desarrollo y staging, los grupos de nodos de Kubernetes deben configurarse para escalar a cero nodos cuando no estén en uso. Las cargas de trabajo de producción deben autoescalarse en función de la demanda en tiempo real.

- La planificación de capacidad es innegociable: Reservar cientos de GPUs A100 o H100 requiere una inversión de capital significativa o compromisos de nube a largo plazo. Una gobernanza FinOps rigurosa y una planificación de capacidad son esenciales antes de firmar esos contratos multianuales.

Para un análisis más profundo de este tema, consulte mi desglose del sector FinOps en la nube: Análisis técnico del sector FinOps en la nube.

Conclusión: Dominando la última milla

La "quinta capa de IA" es donde la inversión sustancial en el desarrollo de modelos de IA finalmente rinde frutos. No es suficiente tener un modelo brillante; debe operacionalizarlo dentro de una aplicación segura, escalable e integrada que ofrezca un valor comercial tangible. Esto requiere un cambio de enfoque de la ciencia de datos pura a la ingeniería de software y sistemas robustos.

Si tuviera 30 segundos para darle mi opinión a un CTO, sería esta: "Sus inversiones en IA están en riesgo si no domina la capa de aplicación. Sin una integración perfecta en sus sistemas empresariales existentes y un camino claro para la retroalimentación del usuario, incluso los modelos más avanzados no lograrán entregar ROI. Todo se trata de la entrega de la 'última milla', no solo del modelo en sí."

Puntos clave

- La integración es clave: Su aplicación de IA debe integrarse de forma segura con los sistemas de identidad, datos y flujo de trabajo existentes. Esto no es opcional.

- Desacople con microservicios: Separe su lógica de inferencia de IA de su lógica de negocio utilizando APIs. Esto es fundamental para lograr escalabilidad y mantenibilidad.

- Construya bucles de retroalimentación: Implemente mecanismos asíncronos y basados en eventos para capturar datos de rendimiento y retroalimentación del usuario para impulsar la mejora continua.

- Gobierne y asegure todo: La firma de modelos, el escaneo de vulnerabilidades y las sólidas pistas de auditoría son innegociables para cualquier sistema de IA en producción.

- Controle sus costos: Las GPUs inactivas son un fallo arquitectónico. Utilice el autoescalado y el escalado a cero para asegurar que los recursos costosos nunca se desperdicien.

Lecturas y recursos adicionales

- Ejemplos oficiales de Kubernetes: Para más patrones de despliegue, consulte el repositorio oficial de ejemplos de Kubernetes.

- Proyecto KServe: Para un servicio de modelos avanzado y gestionado en Kubernetes, consulte el proyecto KServe.

- Ejemplos de API Gateway en la nube: Para ejemplos de cómo asegurar puntos finales, consulte los ejemplos de AWS API Gateway.