Voraussetzungen

Wenn man Unternehmen über ihre KI-Ambitionen sprechen hört, gibt es oft eine tiefe Faszination für Modelle und Algorithmen, aber einen häufigen blinden Fleck für die schiere industrielle Leistungsfähigkeit, die zum Betrieb dieser Systeme erforderlich ist. Die Herausforderung besteht nicht nur darin, intelligente Software zu entwickeln; es geht darum, die physischen Einrichtungen, robuste Netzwerkstrukturen und ausgefeilte Orchestrierung zu entwerfen, die erforderlich sind, um KI in einem Maßstab zu betreiben, der mit einem nationalen Versorgungsunternehmen vergleichbar ist. Wir sprechen hier von einem globalen Netzwerk spezialisierter Rechenleistung, nicht nur von einer abstrakten Rechnung eines Cloud-Anbieters.

Dieser Artikel zerlegt diese entscheidende dritte Schicht der KI – die Rechenzentren und Cloud-Dienste – und zeigt, wie man eine Infrastruktur aufbaut, die KI im industriellen Maßstab unterstützen kann. Mein Ziel ist es, die grundlegenden Komponenten zu entmystifizieren und bewährte Verfahren aus realen Implementierungen zu teilen, indem KI nicht als Magie, sondern als das leistungsstarke Versorgungsunternehmen behandelt wird, das sie zunehmend wird.

Um den konkreten Beispielen folgen zu können, benötigen Sie das Standard-Toolkit für Azure-Bereitstellungen in Produktionsqualität. Die Arbeit mit den neuesten stabilen Versionen gewährleistet Kompatibilität und Zugang zu wichtigen Funktionen.

- Azure CLI: Version

2.58.0oder neuer. Dies ist mein bevorzugtes Tool für die gesamte programmatische Interaktion mit Azure. Überprüfen Sie Ihre Version mitaz --version. - Terraform CLI: Version

1.7.0oder neuer. Für Infrastructure-as-Code ist Terraform unerlässlich, um wiederholbare, versionskontrollierte Umgebungen zu erstellen. Überprüfen Sie dies mitterraform version. kubectlCLI: Version1.29oder neuer. Dies ist der universelle Standard für die Verwaltung von Kubernetes-Clustern. Überprüfen Sie dies mitkubectl version --client.- Azure-Abonnement: Sie benötigen ein aktives Abonnement mit Berechtigungen zum Erstellen von Ressourcen, einschließlich Kubernetes-Clustern, virtuellen Netzwerken und Front Door-Instanzen. Alle meine Beispiele verwenden europäische Regionen wie

westeuropeundnortheurope.

Architektur: Das Versorgungsnetz für Intelligenz

Die industrielle Schicht der KI lässt sich am besten verstehen, indem man Rechenleistung als Versorgungsdienstleistung behandelt. So wie ein Kraftwerk Strom erzeugt, der über ein Netz zu Haushalten und Fabriken fließt, erzeugen Rechenzentren KI-Rechenleistung, die über globale Netzwerke zu Anwendungen fließt. Viele Organisationen unterschätzen die physischen und logistischen Herausforderungen. Es geht nicht darum, ein paar VMs hochzufahren; es geht darum, Strom, Kühlung, Netzwerkkonnektivität und Sicherheit in einem massiven, kompromisslosen Maßstab zu optimieren.

Im Mittelpunkt dieser Schicht stehen die modernen Rechenzentren, die von Cloud-Anbietern wie Microsoft Azure, Amazon oder Google betrieben werden. Diese Einrichtungen beherbergen eine Vielzahl spezialisierter Hardware – insbesondere GPUs –, die durch Netzwerke mit hoher Bandbreite und geringer Latenz miteinander verbunden sind. Cloud-Dienste abstrahieren diese physische Komplexität und bieten skalierbare Rechenleistung (wie Azure Kubernetes Service für GPU-Workloads), intelligentes Networking (Azure Front Door für globales Traffic Management) und robuste Orchestrierung (Azure Functions, Durable Functions und Service Bus).

Die physische Realität hinter der Cloud

Wenn man durch Rechenzentren geht, ist das Ausmaß überwältigend. Das Summen Tausender Server, das schiere Volumen an Luft, das von massiven Kühlsystemen bewegt wird, und die endlosen Reihen akribisch verkabelter Glasfasern – dies ist das physische Fundament der KI. Für jedes in der Cloud laufende Modell gibt es einen entsprechenden Stromverbrauch und einen greifbaren physischen Fußabdruck. Diese Realität untermauert die gesamte dritte Schicht und hat erhebliche FinOps- (d.h. finanzielle) Auswirkungen.

Dieser komponierbare Ansatz, bei dem wir KI mithilfe miteinander verbundener, spezialisierter Dienste aufbauen, ist der Schlüssel. Anstatt monolithischer Systeme nutzen wir Standard-APIs für die Interoperabilität, was unsere beste Verteidigung gegen Vendor Lock-in ist.

Wichtige Architekturkomponenten

Für ein KI-System im industriellen Maßstab konzentriere ich mich auf vier Hauptpfeiler:

-

Hochleistungs-Rechencluster: Hier findet die Hauptarbeit des KI-Trainings und der Inferenz statt. Die Wahl fällt oft auf einen verwalteten Kubernetes-Dienst wie Azure Kubernetes Service (AKS), der auf GPU-fähigen virtuellen Maschinen läuft (ich werde demnächst über serverlose GPUs schreiben). Er bietet die notwendige Orchestrierung zum Bereitstellen, Skalieren und Verwalten containerisierter KI-Workloads ohne den Overhead der Verwaltung der Steuerungsebene.

-

Globales Networking und Edge Delivery: KI-Anwendungen müssen schnell und reaktionsschnell sein, unabhängig vom Standort des Benutzers. Nutzen Sie Dienste wie Azure Front Door oder das globale Netzwerk von Cloudflare als intelligenten Einstiegspunkt. Sie übernehmen TLS-Terminierung, Caching, DDoS-Schutz und effizientes Traffic-Routing zum nächstgelegenen funktionierenden Backend. Dies ist für die Minimierung der Latenz unerlässlich.

-

Datenspeicherung und -verwaltung: KI-Workloads sind datenhungrig. Dies erfordert eine vielschichtige Speicherstrategie: Objektspeicher (Azure Blob Storage) für große Datensätze und Modellartefakte, spezialisierte Vektordatenbanken für Retrieval-Augmented Generation (RAG)-Muster und traditionelle Datenbanken für den Anwendungszustand. Robuste Datenpipelines sind das Kreislaufsystem, das alles verbindet.

-

Orchestrierung und Automatisierung: Über die grundlegende Rechenleistung hinaus ist die Orchestrierung komplexer KI-Workflows entscheidend. Dies beinhaltet die Verwendung von serverlosen Komponenten wie Azure Functions oder Google Cloud Run-Funktionen für zustandslose Aufgaben (z.B. die Vorverarbeitung einer API-Anfrage) und Durable Functions für zustandsbehaftete, langlebige Workflows. Messaging-Dienste wie Azure Service Bus bieten die dauerhafte, asynchrone Verbindung zwischen diesen Microservices.

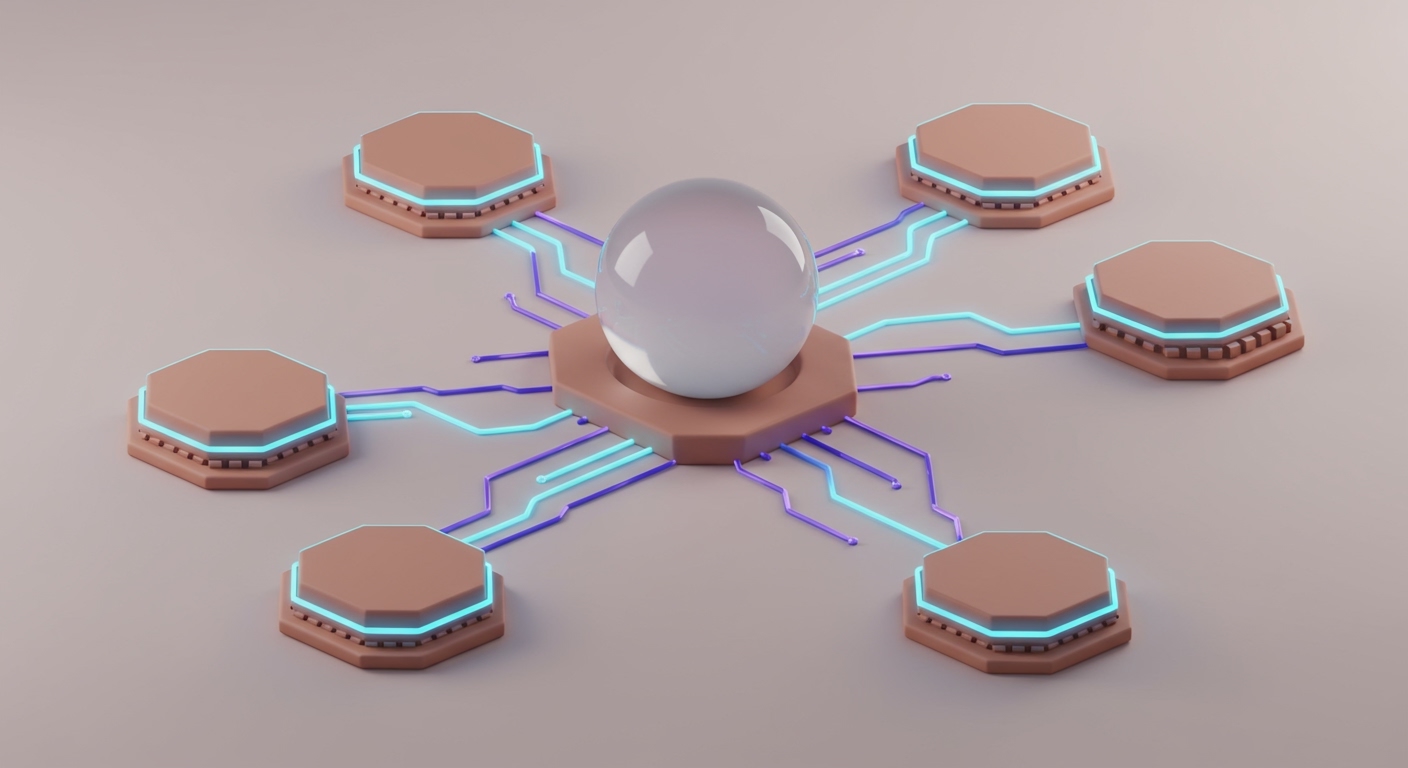

Hier ist ein Diagramm, das zeigt, wie diese Elemente zusammenwirken, um eine kohärente industrielle KI-Schicht zu bilden.

Modell-Governance und Sicherheit

Für jede Produktions-Workload sind Modell-Governance und Sicherheit nicht optional. Dies ist eine grundlegende Checkliste zur Gewährleistung der Integrität, Prüfbarkeit und des verantwortungsvollen Einsatzes von KI-Modellen im großen Maßstab:

- Versionskontrolle: Modelle sind Softwareartefakte. Sie müssen in einem dedizierten Register, wie dem in Azure Machine Learning, versioniert werden, um Rollbacks und nachvollziehbare Bereitstellungsverläufe zu ermöglichen.

- Strikte Zugriffskontrolle: Verwenden Sie detaillierte IAM-Richtlinien, um zu steuern, wer auf Modelle zugreifen, diese bereitstellen und aufrufen kann. Das Prinzip der geringsten Rechte ist von größter Bedeutung.

- Umfassende Audit-Protokollierung: Protokollieren Sie jeden Modellaufruf, einschließlich der Eingabedaten (oder ihres Hashs), der Ausgabe und der Identität des Aufrufers. Dies ist entscheidend für die Nachvollziehbarkeit und Compliance.

- Sichere Endpunkte: Alle Modelle müssen hinter einem sicheren API-Gateway bereitgestellt werden, das Authentifizierung, Autorisierung und Ratenbegrenzung durchsetzt.

- Datenverschlüsselung: Alle Daten, ob während der Übertragung im Netzwerk oder im Ruhezustand im Speicher, müssen mit starken, verwalteten Schlüsseln verschlüsselt werden.

Mit diesem architektonischen Entwurf im Hinterkopf legen wir nun den ersten Teil unseres Fundaments: den Compute-Cluster.

Codebeispiel: Terraform für einen GPU-fähigen AKS-Cluster

Diese Terraform-Konfiguration stellt einen Azure Kubernetes Service (AKS)-Cluster mit einem dedizierten Node-Pool für GPU-fähige Maschinen in westeurope bereit. Dies ist der grundlegende Compute-Block für unsere industrielle KI-Bereitstellung.

# main.tf

# Configure the Azure provider to a European region

provider "azurerm" {

features {}

# Using 'westeurope' as our primary region for compute resources.

# For HA systems, we'd deploy to multiple European regions.

}

resource "azurerm_resource_group" "ai_infra_rg" {

name = "ai-compute-rg-production-eu"

location = "westeurope"

}

resource "azurerm_kubernetes_cluster" "ai_aks_cluster" {

name = "ai-industrial-aks-eu-01"

location = azurerm_resource_group.ai_infra_rg.location

resource_group_name = azurerm_resource_group.ai_infra_rg.name

dns_prefix = "ai-aks-eu"

kubernetes_version = "1.29.4" # Align with current stable AKS versions

default_node_pool {

name = "systempool"

node_count = 2

vm_size = "Standard_DS2_v2"

os_disk_size_gb = 30

auto_scaling_enabled = true

min_count = 1

max_count = 3

}

identity {

type = "SystemAssigned"

}

network_profile {

network_plugin = "azure"

load_balancer_sku = "standard"

service_cidr = "10.0.0.0/16"

dns_service_ip = "10.0.0.10"

docker_bridge_cidr = "172.17.0.1/16"

}

tags = {

"project" = "AIIndustrialScale"

"environment" = "Production"

}

}

# Dedicated node pool for GPU workloads, critical for industrial AI scale.

# This uses 'Standard_NC6s_v3' with NVIDIA V100 GPUs.

resource "azurerm_kubernetes_cluster_node_pool" "ai_gpu_node_pool" {

name = "gpunodepool"

kubernetes_cluster_id = azurerm_kubernetes_cluster.ai_aks_cluster.id

vm_size = "Standard_NC6s_v3"

node_count = 0 # Start with 0 and scale as needed to manage costs

os_disk_size_gb = 60

auto_scaling_enabled = true

min_count = 0

max_count = 5 # Scale up to 5 GPU nodes based on demand

node_labels = {

"agentpool" = "gpunodepool"

"gpu" = "nvidia-v100"

}

tags = {

"environment" = "production"

"ai_layer" = "industrial"

}

}

output "kubernetes_cluster_name" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.name

description = "The name of the Kubernetes cluster."

}

output "kubernetes_cluster_id" {

value = azurerm_kubernetes_cluster.ai_aks_cluster.id

description = "The ID of the Kubernetes cluster."

}

Implementierungsleitfaden

Der Aufbau der industriellen KI-Schicht ist ein methodischer Prozess. Teilen Sie ihn in die Sicherung der Kernrechenleistung, den Aufbau einer globalen Netzwerkreichweite und die Bereitstellung der KI-Workloads auf. Jeder Schritt konzentriert sich auf die Schaffung einer robusten, skalierbaren Infrastruktur, die für den Betrieb im Versorgungsmaßstab geeignet ist.

1. Bereitstellung des GPU-fähigen AKS-Clusters

Zuerst stellen wir den grundlegenden Compute-Cluster mit der oben genannten Terraform-Konfiguration bereit.

# Initialize Terraform in your project directory

terraform init

# Review the planned changes before applying

terraform plan -out=aks_gpu_plan.tfplan

# Apply the Terraform configuration to provision resources

terraform apply "aks_gpu_plan.tfplan"

Nach wenigen Minuten wird Terraform den Vorgang abschließen, und Sie sehen die Ausgaben, die die Erstellung des Clusters bestätigen.

Erwartete Ausgabe:

Apply complete! Resources: 3 added, 0 changed, 0 destroyed.

Outputs:

kubernetes_cluster_id = "/subscriptions/<your-subscription-id>/resourceGroups/ai-compute-rg-production-eu/providers/Microsoft.ContainerService/managedClusters/ai-industrial-aks-eu-01"

kubernetes_cluster_name = "ai-industrial-aks-eu-01"

Dies bestätigt, dass Ihr AKS-Cluster mit seinem GPU-Node-Pool, der für die Skalierung bereit ist, erfolgreich in westeurope bereitgestellt wurde.

2. `kubectl`-Zugriff konfigurieren

Sobald der Cluster läuft, müssen Sie Ihren lokalen kubectl-Client konfigurieren, um mit ihm zu interagieren. Die Azure CLI vereinfacht dies, indem sie die Cluster-Anmeldeinformationen abruft.

# Get AKS cluster credentials (using admin for simplicity, use user auth in production)

az aks get-credentials --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --overwrite-existing --admin

# Verify kubectl connectivity by listing nodes

kubectl get nodes

Erwartete Ausgabe:

Merged "ai-industrial-aks-eu-01-admin" as current context in /home/mark/.kube/config.

NAME STATUS ROLES AGE VERSION

aks-systempool-12345678-vmss000000 Ready agent 5m v1.29.4

aks-systempool-12345678-vmss000001 Ready agent 5m v1.29.4

Beachten Sie, dass die gpunodepool-Nodes noch nicht aufgeführt sind. Das liegt daran, dass wir die anfängliche node_count auf 0 gesetzt haben. Sie werden vom Cluster-Autoscaler bereitgestellt, sobald eine Workload GPU-Ressourcen anfordert.

3. Bereitstellen einer KI-Inferenz-Workload auf GPU-Nodes

Nun stellen wir einen Beispiel-KI-Inferenzdienst bereit. Dieses Kubernetes Deployment-Manifest weist den Scheduler an, unseren Container auf einem GPU-fähigen Node auszuführen und unsere Orchestrierungsschicht mit der spezialisierten Hardware zu verbinden.

# ai-inference-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: gpu-inference-app

labels:

app: gpu-inference

spec:

replicas: 1

selector:

matchLabels:

app: gpu-inference

template:

metadata:

labels:

app: gpu-inference

spec:

# Node affinity ensures this workload runs only on a node with the specified GPU.

nodeSelector:

gpu: "nvidia-v100"

containers:

- name: inference-container

# In a real scenario, you'd use your custom AI model image.

# This public image is a base with CUDA drivers installed.

image: "mcr.microsoft.com/azureml/intelmpi2018.3-cuda10.0-cudnn7-ubuntu16.04:20191010.v"

resources:

limits:

nvidia.com/gpu: 1 # Request 1 GPU from the node

ports:

- containerPort: 80

---

apiVersion: v1

kind: Service

metadata:

name: gpu-inference-service

spec:

selector:

app: gpu-inference

ports:

- protocol: TCP

port: 80

targetPort: 80

type: LoadBalancer # Expose the service with a public IP via Azure Load Balancer

Wenden Sie diese Konfiguration auf Ihren Cluster an:

# Apply the Kubernetes deployment and service

kubectl apply -f ai-inference-deployment.yaml

Erwartete Ausgabe:

deployment.apps/gpu-inference-app created

service/gpu-inference-service created

Dies löst den AKS-Autoscaler aus. Er wird einen Pod sehen, der eine GPU benötigt, feststellen, dass keine Nodes verfügbar sind, und mit der Bereitstellung eines neuen Nodes im gpunodepool beginnen.

4. Einrichtung von globalem Edge-Networking mit Azure Front Door

Um unseren KI-Dienst mit geringer Latenz global zugänglich zu machen, platzieren wir einen globalen Load Balancer wie Azure Front Door davor. Obwohl die vollständige Terraform-Konfiguration umfangreich ist, zeigt dieses konzeptionelle Snippet die wichtigsten Ressourcen.

# networking.tf (conceptual)

# A Web Application Firewall (WAF) policy is a prerequisite for Front Door.

resource "azurerm_cdn_frontdoor_firewall_policy" "ai_waf_policy" {

name = "ai-app-waf-policy"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

enabled = true

mode = "Prevention"

}

# The Front Door profile is the top-level resource.

resource "azurerm_cdn_frontdoor_profile" "ai_afd_profile" {

name = "ai-global-frontdoor-profile"

resource_group_name = azurerm_resource_group.ai_infra_rg.name

sku_name = "Standard_AzureFrontDoor"

}

# An endpoint provides the public-facing hostname.

resource "azurerm_cdn_frontdoor_endpoint" "ai_afd_endpoint" {

name = "ai-endpoint-eu-prod-unique"

cdn_frontdoor_profile_id = azurerm_cdn_frontdoor_profile.ai_afd_profile.id

}

# In a complete configuration, you would also define:

# 1. An Origin Group pointing to the public IP of the 'gpu-inference-service'.

# 2. A Route to connect the public endpoint to the origin group.

# 3. A Security Policy to associate the WAF policy with the endpoint.

Diese Einrichtung nutzt das globale Edge-Netzwerk von Microsoft. Eine Benutzeranfrage trifft den nächstgelegenen Point-of-Presence (PoP), der sie dann effizient über das private Backbone von Microsoft an unseren Inferenzdienst in westeurope weiterleitet und so ein schnelles und sicheres Erlebnis bietet.

Fehlerbehebung & Verifizierung

Die Gewährleistung der Robustheit Ihrer industriellen KI-Infrastruktur erfordert eine gründliche Verifizierung. Meiner Erfahrung nach resultieren die meisten Probleme aus Fehlkonfigurationen im Netzwerk, bei IAM-Berechtigungen oder der Ressourcenzuweisung.

Verifizierungsbefehle

- AKS-Clusterstatus überprüfen:

az aks show --resource-group ai-compute-rg-production-eu --name ai-industrial-aks-eu-01 --query "provisioningState"

**Erwartete Ausgabe:** `"Succeeded"`

- GPU-Node-Präsenz überprüfen (nach Pod-Bereitstellung):

kubectl get nodes --selector=gpu=nvidia-v100

**Erwartete Ausgabe (nach Autoscaling):**

NAME STATUS ROLES AGE VERSION

aks-gpunodepool-12345678-vmss000000 Ready agent 10m v1.29.4

- KI-Inferenz-Pod-Status überprüfen:

kubectl get pod -l app=gpu-inference

**Erwartete Ausgabe:** Der `STATUS` sollte `Running` sein.

- Externe IP des Inferenzdienstes abrufen:

kubectl get service gpu-inference-service

**Erwartete Ausgabe:** Das Feld `EXTERNAL-IP` zeigt nach einigen Minuten eine öffentliche IP-Adresse an. Dies ist die IP, die Sie in Ihrem Front Door Origin konfigurieren.

Häufige Fehler & Lösungen

-

Fehler: Pod bleibt im

Pending-Zustand mitnvidia.com/gpu-Ressourcenwarnung hängen.- Symptom:

kubectl describe pod <pod-name>zeigt ein Ereignis wieFailedScheduling... 0/3 nodes are available: 3 Insufficient nvidia.com/gpu. - Lösung: Dies ist zunächst zu erwarten. Der Cluster-Autoscaler sollte einen neuen GPU-Node bereitstellen. Wenn es länger als 5-10 Minuten dauert, überprüfen Sie die AKS-Diagnose auf Autoscaler-Fehler. Überprüfen Sie außerdem, ob Ihr

nodeSelectorin der Deployment-YAML genau mit dennode_labelsin Ihrer Terraform-Konfiguration übereinstimmt.

- Symptom:

-

Fehler: Dienst

EXTERNAL-IPbleibt lange Zeit<pending>.- Lösung: Dies bedeutet normalerweise, dass der Azure Load Balancer Zeit benötigt, um eine öffentliche IP-Adresse bereitzustellen. Wenn dies länger als 15 Minuten anhält, überprüfen Sie die Aktivitätsprotokolle für die Ressourcengruppe auf Bereitstellungsfehler. Es könnte auch darauf hindeuten, dass Sie ein öffentliches IP-Adresskontingent in Ihrem Abonnement erreicht haben.

-

FinOps-Warnung: Kosten für inaktive GPUs

- Symptom: Ihre Cloud-Rechnung weist hohe Kosten für GPU-VMs aus, die Auslastungsmetriken sind jedoch niedrig.

- Lösung: Dies ist ein klassisches FinOps-Problem. Stellen Sie sicher, dass Ihr Cluster-Autoscaler nicht nur zum Hochskalieren, sondern auch zum Herunterskalieren korrekt konfiguriert ist. Setzen Sie

min_count = 0für teure Node-Pools, die nicht immer benötigt werden. Überwachen Sie die Pod-Planung und die Node-Auslastung genau, um sicherzustellen, dass Sie nicht für inaktive, teure Hardware bezahlen.

Fazit & Nächste Schritte

Die dritte Schicht der KI – das industrielle Rückgrat aus Rechenzentren und Cloud-Diensten – ist der Ort, an dem die eigentliche Arbeit stattfindet. Sie ist die kritische Infrastruktur, die leistungsstarke Modelle in skalierbare, zuverlässige, globale Versorgungsdienstleistungen verwandelt. Als Architekt betone ich ständig, dass das Vernachlässigen dieses Fundaments dem Bau eines Wolkenkratzers auf Sand gleicht. Der Erfolg von KI im großen Maßstab hängt vollständig von der robusten, globalen Infrastruktur ab, die wir bereitstellen.

Die Denkweise eines Versorgungsunternehmens annehmen

Die Metapher 'KI als Versorgungsleistung' ist nicht nur konzeptuell; sie muss unsere architektonischen Entscheidungen bestimmen. Wir entwerfen für Resilienz, Skalierbarkeit und Effizienz, ähnlich wie ein Stromnetzbetreiber. Dies umfasst alles von energieeffizienten Rechenzentrumsdesigns über die automatisierte Skalierung von GPU-Clustern bis hin zu geografisch verteilten Netzwerken. Die finanziellen Auswirkungen sind ebenfalls tiefgreifend und erfordern eine rigorose FinOps-Strategie zur Verwaltung der erheblichen Betriebskosten.

Wichtige Erkenntnisse

- Physische Grundlagen sind entscheidend: Die KI-"Cloud" ist eine massive physische Infrastruktur, die eine sorgfältige Planung für Stromversorgung, Kühlung und Konnektivität erfordert.

- Orchestrierung ist der Schlüssel: Verwaltetes Kubernetes (wie AKS mit GPU-Nodes) ist entscheidend für die effiziente Bereitstellung und Verwaltung von KI-Workloads.

- Globales Networking ist unerlässlich: Edge-Netzwerke und globale Load Balancer (wie Azure Front Door) sind für KI-Dienste mit geringer Latenz und hoher Verfügbarkeit unerlässlich.

- Infrastructure as Code ist obligatorisch: Tools wie Terraform sind entscheidend für wiederholbare, konsistente und versionskontrollierte Infrastrukturbereitstellungen.

Repository-Ressourcen

Der vollständige, projektspezifische Code für eine so umfassende Architektur wird typischerweise in privaten Client-Repositories verwaltet. Die unten aufgeführte offizielle Dokumentation und die öffentlichen Beispiele sind jedoch hervorragende Ausgangspunkte für jede Komponente.

- Azure Quickstart Templates for AKS: `https://github.com/Azure/azure-quickstart-templates/tree/master/quickstarts/microsoft.containerservice/aks

* **Terraform Azure Provider Examples:**

https://github.com/hashicorp/terraform-provider-azurerm/tree/main/examples

* **Advanced Azure ML Examples:**

https://github.com/Azure/azureml-examples

* **Kubernetes Documentation:**

https://kubernetes.io/docs/home/`